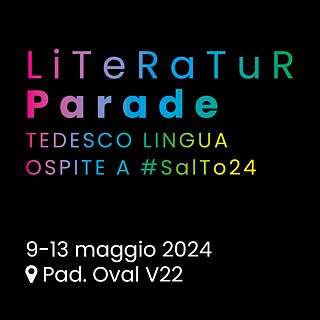

Literatur Parade. Gastsprache Deutsch #SalTo24

Internationale Buchmesse Turin 2024

25 Autor*innen und zahlreiche Events: die Vielfalt der deutschsprachigen Literaturauf der Internationalen Buchmesse in Turin.

Internationale Buchmesse Turin 2024

25 Autor*innen und zahlreiche Events: die Vielfalt der deutschsprachigen Literaturauf der Internationalen Buchmesse in Turin.

Mit Erfahrung zum Erfolg

Das Goethe-Institut bringt die deutsche Sprache in die Welt. In über 90 Ländern bieten wir Deutschkurse und Deutschprüfungen an.

4 Institute in Italien

Wir fördern die Kenntnis der deutschen Sprache im Ausland und pflegen die internationale kulturelle Zusammenarbeit. Mehr als 150 Institute weltweit vermitteln Kultur, Sprache und Information über Deutschland. Daneben gibt es Kooperationen mit anderen Kulturgesellschaften, Bibliotheken und Sprachlernzentren.

Kulturelle Zusammenarbeit