Ētika un tiesības

„Mums jānosaka pašiem savi Eiropas standarti“

Vai mums ir vajadzīgi likumi un ētikas standarti mākslīgā intelekta (MI) attīstībai? Birmingemas Universitātes tiesību, ētikas un datorzinātņu profesore Kārena Jena (Karen Yeung) skaidro, kāpēc ir steidzami jāregulē tehnoloģiju attīstība.

Haralds Vilenbroks

Jenas kundze, savā grāmatā „Algorithmic Regulation“ (tulk. “Algoritmiskie noteikumi”) jūs rakstāt, ka "vismaz angļu un sadraudzības valstu publisko tiesību ekspertu vidū ir maz izpratnes par to, ka likumdošanas procesā var būt sākusies revolūcija". Kāpēc tā?

Vācijas nevalstiskās organizācijas Algorithm Watch Automating Society 2020 jaunākajā ziņojumā aprakstīts, ka publiskais sektors Eiropā automātisku lēmumu pieņemšanai (ALP) izmanto arvien daudzveidīgākas sistēmas. Dažas no šīm sistēmām izmanto mašīnmācīšanos, dažas neizmanto, bet es domāju, ka ir svarīgi runāt par tām visām. Mums ir nopietnāk jāizturas pret ALP un galveno privātās un sociālās dzīves jomu automatizāciju kopumā. Tomēr daudziem cilvēkiem trūkst izpratnes par to – iespējams, arī tāpēc, ka daudzi no šiem procesiem notiek aizkulisēs.

Kāpēc ir tik svarīgi risināt ētikas jautājumus, kas saistīti ar ALP un MI?

Kad mēs domājam par ētiku MI kontekstā, tad ar to domājam mūsu atbildību par to, kā mūsu rīcība ietekmē citus. Ja es jūs nejauši pagrūdīšu, kāda būs mana atbildība pret jums? Kādi ir mani pienākumi pret citiem cilvēkiem un apkārtējo vidi? Šādi apsvērumi, manuprāt, ir labs sākumpunkts diskusijai, jo "MI ētika" tagad ir kļuvusi par sava veida rubriku visam sliktajam, kas saistīts ar MI. Ir daudz vispārēju apgalvojumu par pamatvērtībām, pret kuriem neviens nevar iebilst. Tomēr mums jāpārdomā daudz detalizētāki principi un jāizšķiras, tieši kāda atbildība un kuri pienākumi gulstas uz sistēmu attīstītājiem, ja šīs sistēmas rada negatīvus blakusefektus. Papildus nopietnām problēmām, kas var rasties ne pārāk tālā nākotnē, mums jau tagad ir vairāki nopietni jautājumi, kas jānoskaidro, pirms ieviešam šīs sistēmas. Tās jau ietekmē cilvēku dzīvi – uzreiz un tiešā veidā. Un tāpēc tās jau tagad negatīvi ietekmē mūsu sociālo, kultūras, politisko un ekonomisko vidi.

Vai varat minēt piemēru tam, kā ALP šobrīd ētiski apšaubāmā veidā ietekmē mūsu dzīvi?

Visskaidrāk redzamā ir sociālo mediju ietekme uz sabiedrības diskursu un politiskajām vēlēšanām.

Pēdējā laikā gan pilsoniskā sabiedrība, gan politiķi ir vairākkārt lūguši regulēt informācijas plūsmu sociālajos plašsaziņas līdzekļos, piemēram, aizliegt maldinošu informāciju un viltus ziņas. Tomēr apspriešanās par to, kāda veida informācija būtu jāatļauj, un - platformas vai lietotāji būtu jāsauc pie atbildības un kādi pasākumi varētu būt efektīvi, ir laikietilpīga. Vai šīs strauji augošās tehnoloģijas jau pēc būtības nav tādas, ka to ietekme un iespējas vienmēr aug daudz straujāk, nekā var pieņemt jaunus likumus un regulējumus?

Ir radies pieņēmums - ļoti izplatīts un bieži kritizēts -, ka jurisdikcija nespēj tikt līdzi tehnoloģijām, bet tas ir pārpratums. Problēma nav jurisdikcijā, bet sociālajās normās, saskaroties ar tehnoloģiskajām pārmaiņām. Piemēram, kad parādījās Wi-Fi, radās jautājums par to, vai ir labi pieteikties kāda cita Wi-Fi. Tobrīd attiecībā uz šo tēmu nebija skaidru sociālo normu, un daudzi interneta tīkli sākotnēji nebija aizsargāti ar paroli. Likumi kopumā var labi atspoguļot mainīgās sociālās normas un piemērot noteiktos principus jauniem kontekstiem. Tomēr, ja tehnoloģiskās pārmaiņas nāk un nes līdzi jaunas sadzīves formas, kurās vispārpieņemtās normas vēl nav attīstījušās, likums, kurā teikts "X ir jārada Y", ne vienmēr ir atbilstošs – vismaz ne demokrātiskā sabiedrībā. Un noteikti ne tad, kad izpaliek publiskas debates par to, kas likumam būtu jāpieprasa šajos jaunajos un iepriekš nezināmajos apstākļos. Tāpēc neatbilstība pastāv nevis starp jurisdikciju un tehnoloģijām, bet gan starp sociālajām normām un tehnoloģiskajām pārmaiņām.

Kāpēc tas jo īpaši attiecas uz digitālo pasauli un kā šajā ziņā ir ar citām ļoti inovatīvām disciplīnām?

Šajā ziņā kultūra dažādās zinātnes disciplīnās ievērojami atšķiras. Piemēram, šāds gadījums: kāds savdabīgs pētnieks Ķīnā mēģināja iejaukties cilvēka embrija genomā, lai radītu tā saukto "dizaina mazuli". Par to viņš tika atstādināts no amata, jo zinātniskajā kopienā, kurā viņš iesaistījās, valdīja skaidrs viedoklis, ka šāds solis ir morāli nepiemērots un jautājums ir pretrunīgs, jo īpaši ņemot vērā tehnoloģijas novitāti un tās dziļās sekas indivīdam un sabiedrībai kopumā. Tātad cilvēka biotehnoloģijas jomā pastāv izteikta izpratne par to, ka jauna veida pasākumiem ir jābūt pieņemamiem sabiedrībai, un tāpēc tie ir iepriekš publiski jāapspriež. Šis jomas zinātnieki atzīst, ka ir nozīme jēgpilniem un svarīgiem likumiem, kuri nodrošina tehnoloģiskus jauninājumus un nosaka tiem ierobežojumus. Tomēr digitālajā pasaulē ir tieši pretēji. Tas vienmēr ir saistīts ar ātrumu un to, kā tajā notiek izmaiņas – un ikviens, kam ir portatīvais dators un piekļuve internetam, var pasteidzināt digitālo transformāciju. Hakeru mentalitāte ir radusies no izgudrotājiem un izmēģinātājiem, kurus aizrauj spēles elementi un jaunas iespējas. Pats par sevi viss it būtu kārtībā, ja runa būtu tikai par datorspēļu radīšanu. Bet sabiedrība nav datorspēle.

Kāds risks apslēpts faktā, ka ikviens hakeris var mainīt sabiedrību ātrāk, nekā sociālās normas un likumi var sekot līdzi?

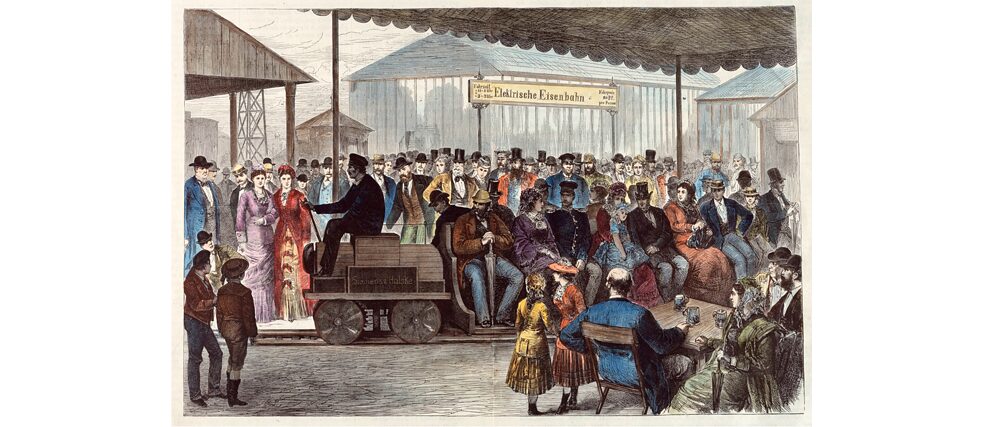

Ir kāds vēsturisks līdzinieks, kas labi atspoguļo mūsu pašreizējo situāciju: pirmā industriālā revolūcija. Kopš tā laika mūsu dzīves kvalitāte neapšaubāmi ir uzlabojusies, bet mēs esam ignorējuši šīs revolūcijas ārējos efektus: mēs ignorējām un pat neapzinājāmies liela mēroga rūpnieciskās ražošanas nevēlamās blakusparādības. Tagad mēs saskaramies ar nopietni vērā ņemamu klimata katastrofu. Šobrīd mums draud iekļūšana tieši tajās pašās lamatās – skatoties ne tikai no ekoloģiskā, bet arī sociālās un politiskās sistēmas viedokļa. Šobrīd esam pārņemti ar sava veida "digitālo burvību" – smieklīgi naivs uzskats, ka, ja mēs būsim pietiekami gudri, algoritmi un dati atrisinās mūsu sociālās problēmas un ka digitālajām tehnoloģijām nav trūkumu. Dažiem šķiet lieliski, ka Alexa var ieslēgt gaismu, pat nepieskaroties slēdzim. Bet mums vajadzētu arī apspriest, ko tas nozīmē, ja mēs ļaujam šādām ierīcēm ar uzraudzības funkciju ienākt mūsu mājās.

Pirmā elektriskā vilciena prezentācija Berlīnē 1879. gadā: Kārena Jena uzskata, ka pirmā industriālā revolūcija ir mūsu pašreizējās situācijas vēsturiskā līdziniece. Mūsu dzīves kvalitāte toreiz uzlabojās, bet tās rezultātā tagad saskaramies ar dramatisku klimata katastrofu.

| Foto (fragments): © picture alliance/akg-images

Galu galā, mēs visi paši varam izlemt, vai mēs vēlamies Alexa savā mājā vai ne, un tāpat arī to, vai ērtības mums ir svarīgākas nekā mūsu privātums – un otrādi. Vai mēs visi galu galā neesam atbildīgi par to, lai apsvērtu, kuras ierīces vēlamies izmantot un kādi trūkumi tām varētu būt?

Pirmā elektriskā vilciena prezentācija Berlīnē 1879. gadā: Kārena Jena uzskata, ka pirmā industriālā revolūcija ir mūsu pašreizējās situācijas vēsturiskā līdziniece. Mūsu dzīves kvalitāte toreiz uzlabojās, bet tās rezultātā tagad saskaramies ar dramatisku klimata katastrofu.

| Foto (fragments): © picture alliance/akg-images

Galu galā, mēs visi paši varam izlemt, vai mēs vēlamies Alexa savā mājā vai ne, un tāpat arī to, vai ērtības mums ir svarīgākas nekā mūsu privātums – un otrādi. Vai mēs visi galu galā neesam atbildīgi par to, lai apsvērtu, kuras ierīces vēlamies izmantot un kādi trūkumi tām varētu būt?

Kad tiek pieprasīti ieroču tirdzniecības ierobežojumi, ASV ieroču lobijam patīk cīnīties ar saukli: "CiIvēkus nenogalina ieroči, cilvēkus nogalina cilvēki." Bet tā ir tikai puse patiesības, jo šautene ir daudz spēcīgāks ierocis nekā sauja akmeņu vai gumijas lentes. Silīcija ielejas gaišākie prāti to visu vienkārši ignorē. Līdzīgi neredzams ir arī lētais darbaspēks no globālajiem Dienvidiem, enerģija, ko patērē mūsu ierīces, un citas negatīvās sekas, kas apzināti tiek novirzītas otrajā plānā, lai nodrošinātu optimālu lietotāja pieredzi.

Kas ir atbildīgs, ja MI sistēma kļūdās? Daudzi cilvēki ir iesaistīti MI programmatūras izstrādē un lietošanā, vai tas būtu programmatūras izstrādātājs, datu analītiķis, īpašnieks vai lietotājs.

„Daudzo pavāru“ problēma ir jau pazīstama arī citās jomās, kur MI nav nekas īpašs. Es vēlētos, kaut IT speciālisti beidzot saprastu, ka šī ir mūžsena problēma, uz kuru jurisdikcija gadu desmitiem ilgi tur gatavībā atbildes. Tomēr ar sarežģītiem produktiem, kas ietver sarežģītas vērtību ķēdes un ražošanas procesu, ar tajā iesaistītām vairākām organizācijām un daudziem cilvēkiem, rodas tieši tādi paši jautājumi. Likums to atrisina, sakot: "Ikviens ir atbildīgs, un iesaistīto pašu ziņā ir savstarpēji sadalīt atbildību, kurai likums pēc tam piedāvā risinājumu." Svarīgākais, lai galīgā atbildība nebūtu jāuzņemas tiem, kas patiesībā nav iesaistīti.

Jūs bijāt ES augsta līmeņa ekspertu grupas locekle mākslīgā intelekta jautājumos. Kādus pasākumus MI regulēšanā jūs ierosināt ES?

Šeit es vēlreiz diskusijā vēlētos iekļaut atkal ALP, nevis tikai runāt par MI. Visas uz programmatūru balstītās lēmumu pieņemšanas sistēmas darbojas ātrā tempā un milzīgā apjomā – MI to vēl tikai saasina un paātrina. Augsta līmeņa ekspertu grupa MI jautājumos sāka darbu pirms vairāk nekā diviem gadiem, izstrādājot pilnībā brīvprātīgas ētikas pamatnostādnes par uzticamu MI. To pamatā bija ļoti cēli un vērā ņemami principi, bet diemžēl grupa nav tādā pozīcijā, lai tos pilnībā ieviestu. ES Komisija ir publicējusi priekšlikumu par MI regulēšanu, paziņojot, ka piedāvā "uz risku orientētu" pieeju. Tomēr, neraugoties uz vislabākajiem nodomiem, šis regulēšanas priekšlikuma saturs vispār nerisina riskus. Godīgi sakot, tas sagādāja diezgan lielu vilšanos.

No kurienes rodas nevēlēšanās regulēt MI?

Šādās krīzēs, kad produktivitāte un ekonomiskā labklājība tiek uzskatītas par īpaši svarīgām, valdības cer uz to, ka mūs glābs tehnoloģiju industrija. Neviens nevēlas nokaut „zelta zosi“. Un zoss pastāvīgi sūdzas un saka: "Ja jūs man uzliksiet kādus ierobežojumus, viss mans radošums un manas spējas zudīs." Citiem vārdiem sakot, pastāv šī vispārinātā, neticami neapšaubāmā pārliecība, ka regulējums apslāpē inovāciju. Tās ir pilnīgas muļķības. Bez likumiem nebūtu izpildāmu līgumu un nebūtu īpašuma tiesību.

Cik liels, jūsuprāt, ir risks, ka uzņēmumi „noenkurosies“ uz dzīvi valstīs, kurās ir zemāki tiesiskie standarti, un ka mēs attiecīgi konkurēsim pasaules mērogā par zemākiem standartiem ALP un MI ziņā?

Es neticu apgalvojumam: "Ķīna vai ASV mūs iznīcinās, ja mēs paši sevi regulēsim". Starptautiski mums ir vajadzīgi nolīgumi par militārajām tehnoloģijām un aizliegumi attiecībā uz noteiktiem lietojumiem. Turklāt, ja Ķīna un ASV vēlas saglabāt zemākus standartus civiltiesību jomā, mēs nedrīkstam tām uzspiest savas kolektīvās vērtības citādi nekā ar to, kā šīs vērtības nosaka mūsu pašu dzīvi. Eiropas sabiedrībai jāapspriež un jāizlemj, kādu praksi mēs Eiropā uzskatām par pieņemamu un kādā sabiedrībā mēs vēlamies dzīvot. Un tad mums ir jādzīvo saskaņā ar šiem principiem, normām un standartiem.

Ko praksē nozīmētu "dzīvot pēc mūsu normām"?

Es jums minēšu kādu piemēru: ja medicīnā izmantotā tehnoloģija no Ķīnas tika barota ar datiem, attiecībā uz kuriem ir pārkāptas pilsoņu datu aizsardzības tiesības vai par kuru ievākšanu viņi nebija informēti un kam nebija piekrituši, tad mēs nedrīkstam pieļaut, ka šo tehnoloģiju importē Eiropā. Un, ja tiešsaistes tirgus Alibaba – vai citi – vēlas aktivizēties Eiropā, tad viņi to var darīt, bet ar priekšnosacījumu, ka ievēro mūsu noteikumus. ES Vispārīgā datu aizsardzības regula (VDAR) ir lielisks piemērs mūsu kopīgajai ticībai par datu drošību un vajadzību pēc juridiski izpildāmiem standartiem. Mums ir jānosaka savi standarti un tad pēc tiem arī jādzīvo.

Vīrietis sērfo Alibaba mājas lapā: Ja ārvalstu platformas, piemēram, ķīniešu Alibaba, grib darboties Eiropā, tad tām ir jāievēro ES noteikumi.

| Foto (fragments): © Adobe

Cik reāli ir tas, ka mēs spēsim izpildīt šo prasību starptautiskā vidē? Piemēram, ja es vēlos sazināties ar draugiem, kuri ir izkaisīti visā pasaulē, tad es to daru, izmantojot dominējošo platformu Facebook. Un šo platformu neradīja pēc mūsu izstrādātajiem standartiem, bet saskaņā ar ASV esošajiem.

Vīrietis sērfo Alibaba mājas lapā: Ja ārvalstu platformas, piemēram, ķīniešu Alibaba, grib darboties Eiropā, tad tām ir jāievēro ES noteikumi.

| Foto (fragments): © Adobe

Cik reāli ir tas, ka mēs spēsim izpildīt šo prasību starptautiskā vidē? Piemēram, ja es vēlos sazināties ar draugiem, kuri ir izkaisīti visā pasaulē, tad es to daru, izmantojot dominējošo platformu Facebook. Un šo platformu neradīja pēc mūsu izstrādātajiem standartiem, bet saskaņā ar ASV esošajiem.

Jums ir pilnīga taisnība. Mēs joprojām lietojam pieeju "rīkoties ātri un visu sabojāt". Bet tas pamazām izsīkst. Likumdevēji sāk pretuzbrukumu, un pieaug vienprātība, ka šīm platformām ir pārāk daudz varas, kuru nepieciešams iegrožot. Ja politiskā griba ir pietiekami spēcīga, mēs varam nopietni risināt šīs lietas. Bet jums es piekrītu: mēs vēl esam tālu no tā. Mums ir vajadzīga kolektīva rīcība.

Izklausās, ka esat noskaņota diezgan optimistiski.

Nevis optimistiski, bet cerīgi. Es zinu, ka joprojām tiek nodarīts liels kaitējums, pirms digitālā inovācija kļūs atbildīga. Tas viss notiek tik ātri, ka cilvēki tikpat kā nemana attīstību, tā ir grūti saprotama un arī ļoti sarežģīta. Piemēram, es nezinu, cik daudz uzņēmumu mūs izseko mūsu intervijas laikā tiešsaistē – iespējams, vairāk nekā 150, vai ne? Mēs jūtamies tik bezspēcīgi, ka pieļaujam lietas, kuras mēs nekad neakceptētu citās mūsu dzīves jomās.

Ko jūs cilvēkiem iesakāt attiecībā uz datu aizsardzību un drošību? Šķiet, ka pastāv vispārēja vienprātība par to, ka jūs kā indivīds neko nevarat darīt.

Labs jautājums. Es viņiem teiktu: neizslēdziet smadzenes. Pārdomājiet labāk savu digitālo mijiedarbību. Mainiet savus privātuma iestatījumus un preferences uz nepieciešamākajām, nepērciet bērnam viedtālruni, kamēr viņš nav pietiekami vecs, lai to izmantotu atbildīgi, un Dieva dēļ, lūdzu, nepērciet novērošanas aprīkojuma ierīces savām mājām un privātajām telpām.

Kāds ir jūsu sliktākais scenārijs attiecībā uz MI?

Tā būtu Ķīnas glancētā versija Eiropā, t.i., autoritārs režīms, sajaukts kopā no valdības un tehnoloģiju uzņēmumu varas – mēs kļūsim par tirgus preci: smaidīgi, laimīgi cilvēki. Kādu mēs šodien varam iztēloties nākotni? Diezgan līdzīgu Oldesa Hakslija romānā „Brīnišķīgā jaunā pasaule“ attēlotajai.