Les erreurs productives

L’erreur dans l’IA en art

En art, l’erreur est rarement fatale […] et parce qu’elle est généralement plus productive que contre-intuitive, elle est souvent accueillie avec une certaine reconnaissance, celle que l’on réserve habituellement à l’éblouissement d’une idée nouvelle, à la révélation d’un impensé. Avec un pas de côté, le crabe qu’est l’erreur consiste parfois, et même souvent, en un précieux véhicule de réflexion pouvant devenir une méthode en soi.

Le droit à l’erreur de l’IA

L’erreur est de l’ordre de la surprise, de l’imprévu. Lorsqu’elle survient, elle est immédiatement identifiée à un résultat ne correspondant pas aux attentes, ou du moins qui ne se situe pas dans le spectre alloué au résultat attendu. Ceci implique donc un espace de prévisibilité dans lequel sont évacué les infinies variables qui relèvent du hasard. L’erreur nous renseigne tout à la fois sur ce qui est souhaité et rejeté : elle aide à en circonscrire les contours, à identifier les éléments indésirables. L’erreur est un indice concave. Et lorsqu’associée à l’intelligence artificielle (IA), elle se teinte d’une relative menace. L’IA – qu’il faut essentiellement comprendre comme des ensembles d’algorithmes – est de plus en plus utilisée dans divers contextes de la vie quotidienne. Qu’il s’agisse d’Alexa déjà bien installée dans nos maisons, de systèmes automatisés de gestion de personnel d’entreprise, ou de véhicules autonomes qu’Uber souhaite introduire sur le marché, il faut se rendre à l’évidence que l’IA a déjà pris sa place parmi nous. Et lorsqu’elle fait erreur, ça va de l’indiscrétion presque anodine – quoique ce genre de chose peut aussi tourner au drame –, à la discrimination d’embauche – plus grave –, jusqu’à la fatalité d’une collision où un corps est interprété comme un étant un sac – avec la mort pour erreur irréversible.L’erreur est un crabe

En art, l’erreur est rarement fatale – quoique certaines œuvres de performance auraient pu ou pourraient démentir cette affirmation – et parce qu’elle est généralement plus productive que contre-intuitive, elle est souvent accueillie avec une certaine reconnaissance, celle que l’on réserve habituellement à l’éblouissement d’une idée nouvelle, à la révélation d’un impensé. Avec un pas de côté, le crabe qu’est l’erreur consiste parfois, et même souvent, en un précieux véhicule de réflexion pouvant devenir une méthode en soi. Ceci dit, l’erreur dans les pratiques artistiques qui intègrent l’IA relève le plus souvent de deux types : les erreurs qui viennent souligner l’incompétence de l’IA en cause ; et celles qui n’en sont pas parce qu’elles font partie d’un processus d’apprentissage, et pour lesquelles nous avons l’indulgence de l’adulte devant l’enfant. Entre le deux, une confusion peut à tout moment s’installer. En effet, quoi que fasse l’IA, elle ne peut que susciter l’incertitude – du moins pour le moment.Myopie algorithmique

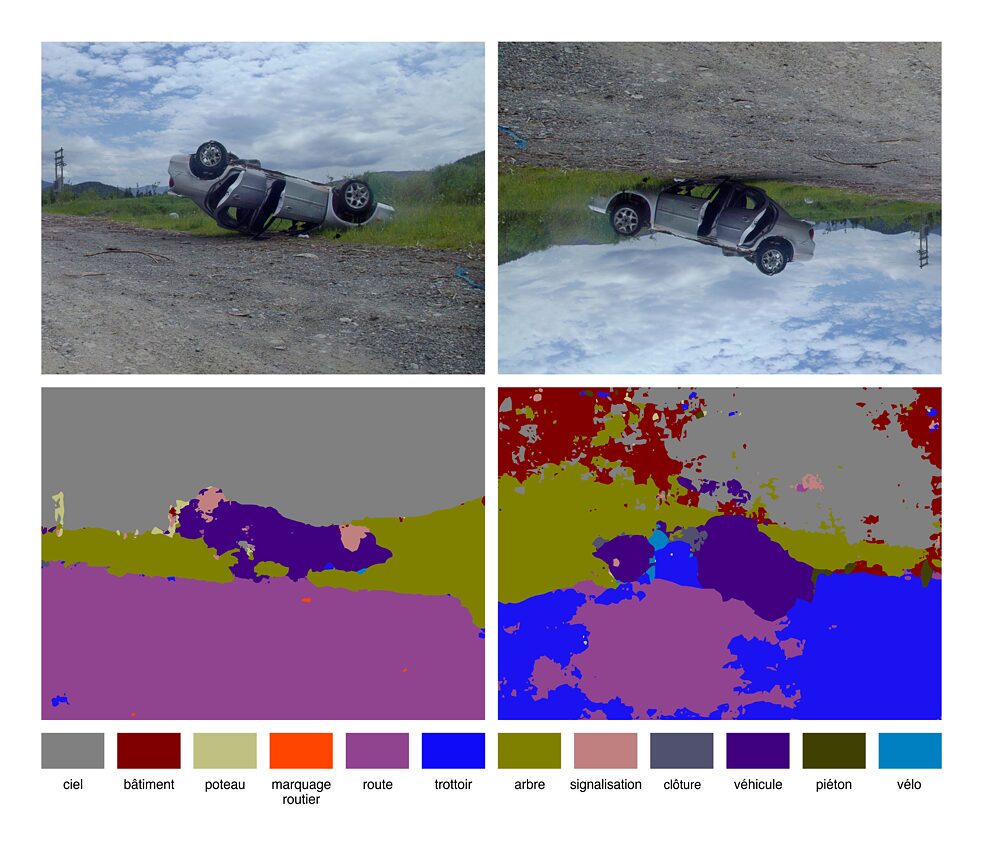

L’artiste montréalais François Quévillon a beaucoup travaillé, ces dernières années, sur la question de l’automatisation des machines, et notamment celle des véhicules autonomes. Ces derniers, on le sait, détiennent un excellent niveau de productivité en terme de ratés. C’est le lot de tout processus d’apprentissage : le doublé essai-erreur, et ce « package » constitue un matériau de prédilection. À travers la perspective artistique, l’erreur se rapproche plus de ce qui permet d’apprécier un point de vue autre que quelque chose de « faux » et qu’il faudrait rectifier. L’erreur en art n’est pas un fait objectif. De là, on peut l’interpréter librement sur l’échelle de l’inexactitude, jusqu’à l’utiliser comme matériau en resituant son statut initial. Voiture sans conducteur dans l’au-delà de François Quévillon – une impression numérique de 2017 – joue entièrement sur ce statut : le résultat erroné que nous offre l’IA, incapable d’interpréter correctement ce qu’elle voit – l’image inversée d’une voiture renversée – devient ici le vecteur d’une perspective visuelle qui vient abstraire le sujet, pourtant pris pour ce qu’il est jusque dans l’intitulé de l’œuvre : l’aspect factuel de la voiture renversée est sans équivoque. Voiture sans conducteur dans l’au-delà, 2017. Épreuve numérique sur papier archive. 90 x 77 x 3 cm. | Courtesy of the artist © François Quévillon.

Voiture sans conducteur dans l’au-delà, 2017. Épreuve numérique sur papier archive. 90 x 77 x 3 cm. | Courtesy of the artist © François Quévillon.

Est-ce vraiment une erreur ?

La réalité vue à travers les algorithmes est en général appelée à être interprétée avec une extrême froideur, ce qui donne à l’erreur des allures d’affirmation autoritaire – alors qu’il n’y a bien sûr aucune intentionnalité derrière ses assertions. L’installation Asunder (2019) des artistes Tega Brain, Julian Oliver, et Bengt Sjölén, qui était notamment présentée dans le cadre de la dernière édition de Transmediale à Berlin est un système d’intelligence artificielle – fonctionnant à partir d’ordinateurs « custom » très puissants – traitant en temps réel une énorme quantité de données en ligne afin de proposer des solutions à différentes problématiques environnementales. Plus concrètement, une région géographique est circonscrite et analysée ; ses « problèmes » sont identifiés ; puis des « solutions » sont proposées.Cependant, ces « solutions » ne sont pas nécessairement réalistes et, pour la plupart, carrément impossibles. Lorsque l’IA suggère de déplacer un lac ou une ville entière, fait-elle erreur ou ne fait-elle qu’appliquer une implacable et froide logique ? Peut-être faudrait-il réévaluer les critères sur lesquels nous basons nos décisions, peut-être aussi nous faudra-t-il éventuellement envisager une certaine vision utopique – qui, d’où nous sommes actuellement situés, serait perçue comme une erreur – afin de pouvoir se projeter dans un avenir viable. L’erreur d’aujourd’hui n’est peut-être finalement que la solution de demain.

« Qu’on lui coupe la tête ! » dirait la Reine de cœur

L’IA cependant, dans un monde idéal, n’aurait pas droit à l’erreur. Le film Make Me Up (2018) de l’artiste écossaise Rachel Maclean le souligne à travers un scénario dont l’humour noir et le sens critique a le tranchant d’un couteau de boucher, littéralement. Siri en effet – tout comme Alexa et d’autres IA sous la domination d’un entraînement, doublé d’un esprit de compétition cruel et absurde – se voit réveillée en pleine nuit par un maître-tyran qui lui demande de lui dévoiler « quand sera la fin du monde… ? » Siri ne sait pas. Se fait couper la tête. Le cauchemar recommence. Ce n’est qu’un aspect de ce film fort complexe qui nous parle d’un capitalisme du futur, d’un totalitarisme maquillé et infantilisant, et d’un univers sous constante surveillance. C’est aussi un pamphlet féministe fort éloquent. Du bonbon et du poison tout à la fois.L’IA sous entraînement, c’est ce sur quoi nous basons actuellement notre capital de demain. Nous y plaçons beaucoup d’espoir et d’argent. Nous la souhaitons par conséquent la plus exacte possible dans ses « tâches ». Heureusement pour nous, elle n’est pas prête de pouvoir prédire la fin du monde – ça nous laisse un sursis pour apprécier la poésie de ses maladresses.