Produktive Fehler

Künstlich intelligente ... Kunstfehler

In der Kunst sind Fehler selten fatal […] Weil Fehler im Allgemeinen eher produktiv denn kontraintuitiv sind, werden sie oft mit einer gewissen Anerkennung aufgenommen, die normalerweise nur der Blendung durch eine neue Idee oder der Offenbarung von etwas bislang Ungedachtem vorbehalten ist. Die seitwärtslaufende Krabbe, die an sich ein Fehler ist, stellt manchmal und sogar oftmals ein wertvolles Mittel der Reflexion dar, das zu einer eigenen Methode avancieren kann.

Das Recht auf Fehler in der künstlichen Intelligenz

Fehler fallen in die Kategorie der Überraschungen und des Unvorhergesehenen. Wenn ein Fehler passiert, wird er sofort erkannt als ein Ergebnis, das nicht mit den Erwartungen übereinstimmt oder sich zumindest nicht im zugewiesenen Spektrum des erwarteten Resultats befindet. Dies impliziert, dass es einen Raum der Vorhersehbarkeit gibt, aus dem die unendlichen, dem Zufall überlassenen Variablen verbannt sind. Ein Fehler signalisiert zugleich Gewünschtes und Unerwünschtes; er hilft uns, dessen Umrisse zu skizzieren und die unerwünschten Elemente zu identifizieren. Ein Fehler ist ein konkaver Indikator. In der künstlichen Intelligenz (KI) bekommt ein Fehler die Schattierung einer relativen Bedrohung. KI, die im Wesentlichen als eine Summe von Algorithmen zu verstehen ist, wird zunehmend in verschiedenen Alltagsbereichen eingesetzt. Ganz gleich, ob es sich um die bereits in unserem Zuhause gut etablierte Alexa handelt, um automatisierte Personalmanagementsysteme für Unternehmen oder selbstfahrende Fahrzeuge, die Über gern auf den Markt bringen würde, es ist klar, dass KI bereits einen festen Platz in unserer Mitte eingenommen hat. Und wenn sie einen Fehler macht, dann kann das von einer nahezu harmlosen Indiskretion reichen – obwohl eine solche auch eine dramatische Wendung nehmen kann – bis hin zur schwerwiegenderen Diskriminierung bei der Mitarbeiterrekrutierung oder einer Kollision mit Todesfolge, weil ein Körper als eine Tasche wahrgenommen wurde. In einem solchen Fall stellt der Tod einen irreversiblen Fehler dar.Fehler sind wie Krabben

In der Kunst ist ein Fehler selten fatal, auch wenn einige Performance-Werke diese Auffassung widerlegen könnten. Weil Fehler im Allgemeinen eher produktiv denn kontraintuitiv sind, werden sie oft mit einer gewissen Anerkennung aufgenommen, die normalerweise nur der Blendung durch eine neue Idee oder der Offenbarung von etwas bislang Ungedachtem vorbehalten ist. Die seitwärtslaufende Krabbe, die an sich ein Fehler ist, stellt manchmal und sogar oftmals ein wertvolles Mittel der Reflexion dar, das zu einer eigenen Methode avancieren kann. Vor diesem Hintergrund lassen sich Fehler, die passieren, wenn KI in Kunst integriert wird, am häufigsten in zwei Typen unterteilen: Fehler, welche die Inkompetenz der angewandten KI hervorheben, und Fehler, die gar keine sind, weil sie Teil eines Lernprozesses sind. Letztere behandeln wir mit der Nachsicht eines Erwachsenen für ein Kind. Diese beiden Fehlertypen können jederzeit durcheinandergebracht werden. Aber ganz gleich, was KI auch tut, sie kann nur Unsicherheit erzeugen, zumindest für den Moment.Algorithmische Kurzsichtigkeit

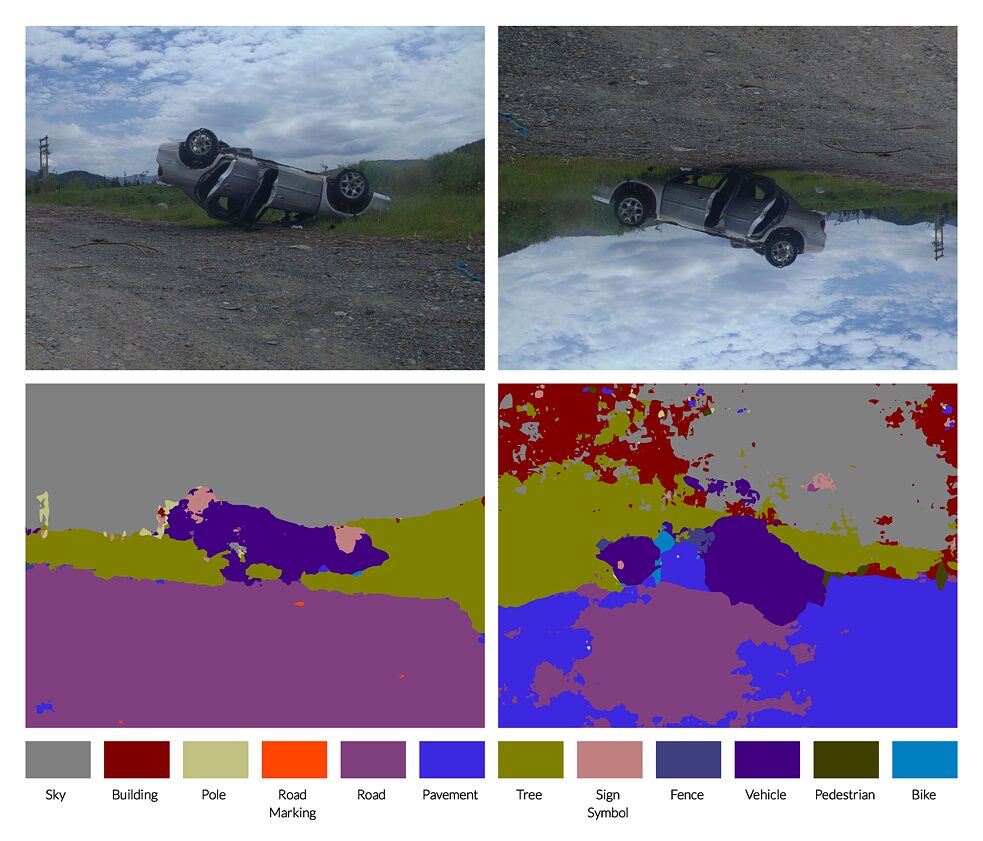

Der Montrealer Künstler François Quévillon hat sich in den letzten Jahren viel mit der Frage der Automatisierung von Maschinen beschäftigt, insbesondere mit selbstfahrenden Fahrzeugen. Diese erreichen, was Fehlleistungen anbelangt, bekanntlich eine hervorragende Quote. Das doppelte Prinzip von Versuch und Irrtum ist das Los eines jedes Lernprozesses und dieses „Paket“ stellt gemeinhin das bevorzugte Material dar. Aus der künstlerischen Perspektive ist ein Fehler eher etwas, was uns erlaubt, einen Standpunkt schätzen zu lernen, und nicht etwas, das „falsch“ ist und korrigiert werden sollte. In der Kunst ist ein Fehler keine objektive Tatsache. Auf dieser Basis lässt er sich dann frei auf der Skala der Ungenauigkeit interpretieren, bis hin zur Verwendung des Fehlers als Material zur Wiederherstellung des ursprünglichen Zustands. Auto ohne Fahrer im Jenseits (Voiture sans conducteur dans l’au-delà) von François Quévillon, eine digitale Sequenz aus dem Jahr 2017, spielt diese Prämisse voll aus: das falsche Ergebnis, das uns KI liefert, unfähig zur richtigen Interpretation dessen, was sie sieht. Fahrerloses Auto im Jenseits, 2017. Digitaldruck auf Archivpapier. 90 x 77 x 3 cm.

| Courtesy of the artist © François Quévillon.

Das auf den Kopf gestellte Bild eines umgestürzten Autos wird hier zum Vektor einer visuellen Perspektive, die das Thema abstrahiert, aber im Titel des Werks aufgefasst wird als das, was es ist. Der sachliche Aspekt des umgestürzten Autos ist schließlich eindeutig. Aus dem Blickwinkel der KI wird das Bild jedoch zu etwas anderem: Bürgersteig, Fahrrad und Zaun, Gebäude, die sich um den Himmel streiten; Beschilderung, die im Nirgendwo schwebt.

Fahrerloses Auto im Jenseits, 2017. Digitaldruck auf Archivpapier. 90 x 77 x 3 cm.

| Courtesy of the artist © François Quévillon.

Das auf den Kopf gestellte Bild eines umgestürzten Autos wird hier zum Vektor einer visuellen Perspektive, die das Thema abstrahiert, aber im Titel des Werks aufgefasst wird als das, was es ist. Der sachliche Aspekt des umgestürzten Autos ist schließlich eindeutig. Aus dem Blickwinkel der KI wird das Bild jedoch zu etwas anderem: Bürgersteig, Fahrrad und Zaun, Gebäude, die sich um den Himmel streiten; Beschilderung, die im Nirgendwo schwebt. KI visualisiert demnach etwas Unbewusstes, das uns entgeht, einen surrealen Algorithmus. Im Originalbild sind die Räder Straßenschilder, die nur von den „Augen“ der KI gesehen werden: sie betonen zugleich den äußerst rationalen und „unfallfreien“ Ort, den das Konzept der Realität für die KI darstellt, oder, um es genauer zu sagen: die Formel eines „Realitätskonzept“, die eher ein Bild darstellt als eine Realität.

Ist es wirklich ein Fehler?

Die Interpretation der Realität seitens der Algorithmen erfolgt mit extremer Kälte, was dem Fehler einen autoritativen Anschein gibt, obwohl bestimmt keine Absicht seitens der KI dahintersteht. Auf der letzten Transmediale, einem Festival für Medienkunst und digitale Kultur in Berlin, stellten Tega Brain, Julian Oliver und Bengt Sjölén ihre künstlerische Installation Asunder (2019) vor. Dieses System künstlicher Intelligenz wird gesteuert durch eigens zu diesem Zweck entwickelte hochleistungsfähige Computer, die in Echtzeit eine enorme Datenmenge verarbeiten, um Lösungen für verschiedene Umweltprobleme vorzuschlagen. Konkret wird dabei eine geografische Region beschrieben und analysiert und ihre “Probleme“ werden identifiziert, anschließend werden “Lösungen“ vorgeschlagen.Diese „Lösungen“ sind jedoch nicht zwangsläufig realistisch und größtenteils schlichtweg unmöglich. Wenn KI vorschlägt, einen See oder eine Stadt komplett zu verlegen, macht sie dann einen Fehler oder wendet sie nur eine unerbittliche und kalte Logik an? Vielleicht sollten wir die Kriterien, auf deren Grundlage wir Entscheidungen treffen, neu bewerten, vielleicht sollten wir unter Umständen eine utopische Vision ins Auge fassen, um eine lebensfähige Zukunft zu entwerfen, selbst wenn diese Vision von unserem gegenwärtigen Standpunkt aus gesehen als Fehler wahrgenommen würde. Die Fehler von heute sind am Ende vielleicht die Lösungen von morgen.

„Schlagt ihm den Kopf ab!“ würde die Herzkönigin sagen

In einer idealen Welt dürfte KI jedoch keine Fehler machen. Der Film Make Me Up (2018) der schottischen Künstlerin Rachel Maclean hebt dies in Form eines Szenarios hervor, dessen schwarzer Humor und Kritik buchstäblich die Schärfe eines Metzgermessers besitzen. Siri, die ebenso wie Alexa und andere wohl trainierte KI-Assistenten gepaart ist mit einem grausamen und absurden Konkurrenzdenken, wird mitten in der Nacht von einem tyrannischen Meister geweckt, der wissen will, „wann die Welt endet.“ Aber Siri weiß das nicht. Ihr wird der Kopf abgeschlagen und der Alptraum beginnt von vorn. Dies ist nur ein Aspekt dieses höchst komplexen Films, der von einem Kapitalismus der Zukunft erzählt, von einem maskierten und infantilisierenden Totalitarismus und von einem permanent überwachten Universum. Der Film ist auch ein sehr eloquentes feministisches Manifest, Zuckerbrot und Peitsche zugleich.Trainierte KI ist das, worauf wir in der Tat unser Zukunftskapital basieren. Wir setzen viel Hoffnung und Geld darauf. Daher wollen wir, dass künstliche Intelligenz bei der Erfüllung ihrer „Aufgaben“ so präzise wie möglich vorgeht. Zum Glück ist sie nicht bereit, das Ende der Welt vorauszusagen – und damit bekommen wir einen Aufschub, um die poetische Natur ihrer Unbeholfenheit zu würdigen.