KI und Kunst Bedeutungsverlust im Studio-Ghibli-Stil

Was bleibt von der Kunst, wenn KI alles imitiert? Ein Essay über Ghibli-Filter und die stille Erosion kultureller Bedeutung im Zeitalter generativer KI-Systeme.

Eine persönliche Schreckensprophezeiung wird wahr. Damals, 2019, als KI mit dem simplen GPT-2 noch eher ein Nischenthema war, prophezeite ich, die Technologie würde eine „semantische Apokalypse“ auslösen und auf diese Weise Kunst und Sprache ihrer Bedeutung berauben. Dies war sogar Thema des allerersten Essays, das ich für meinen Newsletter The Intrinsic Perspective schrieb.Das dystopische Zukunftspotenzial wurde mir in exakt dem Moment bewusst, als ich eine bestimmte Zeile in Kane Hsiehs inzwischen vergessenem Experiment Transformer Poetry las, in dem er von GPT-2 verfasste Gedichte veröffentlichte. Die meisten waren nicht gut, aber an einem bestimmten Punkt schrieb das System:

„Thou hast not a thousand days to tell me thou art beautiful.“

Ich sah die Zeile und dachte: „Fuck.“

Sechs Jahre später ist die semantische Apokalypse in vollem Gange. Menschen berichten von Erfahrungen mit genau den inneren psychischen Veränderungen, die ich für unser kollektives Bewusstsein damals vorausgesagt habe.

Die Ghiblifizierung des Internets

Im März 2025 hat OpenAI seinen neuesten Bildgenerator auf den Markt gebracht, der sogar im Vergleich zur Vorjahrestechnologie noch deutlich leistungsstärkere Funktionen bietet. In einem Tweet schlug jemand vor, die neue KI als „Studio-Ghibli“-Filter für Familienfotos zu nutzen. 20 Millionen Klicks später überflutete Studio Ghibli das Internet.

Ein Foto der Kinder des Autors, welches durch einen ChatGPT-Filter aussieht, wie aus einem Studio Ghibli-Film | Foto: © Erik Hoel

Warum? Weil OpenAI mit seiner Strategie offenbar böse Absichten verfolgt oder zumindest den Anschein erwecken könnte: Die Entwickler*innen trainieren ihre Modelle darauf, speziell diejenigen Künstler*innen zu imitieren, die ihnen persönlich gefallen. Im Bereich Anime ist das mit großer Wahrscheinlichkeit Miyazaki. Allerdings ist dasselbe gerade mit dem neuen Creative-Writing-Bot des Unternehmens passiert, der (ähem, so scheint es zumindest) darauf trainiert wurde, Nabokov zu imitieren.

Dieser Bot ist zwar noch nicht auf dem Markt, doch schon zu Jahresbeginn gab es eine erste Rezension, als Sam Altman eine von diesem Bot geschriebene Kurzgeschichte veröffentlichte. Die ging viral, denn obwohl sie völlig übertrieben geschrieben war (ein klassischer Anfängerfehler), enthielt sie immerhin einige gute Metaphern, zum Beispiel, als die KI sinnierte:

“I am nothing if not a democracy of ghosts.”

Im Grunde waren sie zu gut. Und kamen mir auf unheimliche Weise bekannt vor. Ich sah nach, und jawohl, es war direkt von Nabokov übernommen.

“Pnin slowly walked under solemn pines. The sky was dying. He did not believe in an autocratic God. He did believe, dimly, in a democracy of ghosts.”

Der Rest der Geschichte liest sich, als hätte jemand abwechselnd Nabokov und Murakami nachgeäfft, beide, wie es der Zufall so will, Lieblingsschriftsteller einiger der am Projekt beteiligten Teammitglieder. Überraschung!

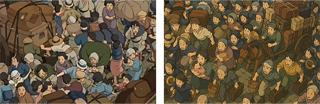

Ebenso funktioniert der neue Bildgenerator mit anderen Anime-Stilen etwas schlechter. Bei Studio Ghibli würde ich zwar nicht so weit gehen, von einem passablen Ergebnis zu sprechen, doch einige Motive können sich durchaus sehen lassen. Die KI kann nicht alle typischen Ghibli-Details berücksichtigen – sie ist noch immer in ihrer Intelligenz und Kreativität beschränkt, nicht aber in ihrer Fähigkeit, Stile zu kopieren. An der Szene unten links hat ein echter Studio-Ghibli-Künstler 15 Monate gearbeitet. Das Bild unten rechts habe ich innerhalb von 30 Sekunden geprompted.

Studio Ghibli (links); die mit ChatGPT nachgebildete Szene (rechts) | Foto: © Erik Hoel

Bedeutung und Zauber gehen verloren

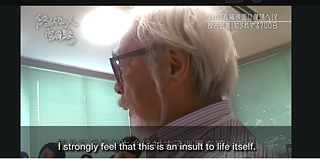

Die Ironie der Ghiblifizierung des Internets besteht darin, dass Miyazaki keinen Hehl aus seinem Hass auf KI macht. In einer Dokumentation sagte er einmal:Dass ChatGPT keine perfekte Miyazaki-Kopie generieren kann, spielt dabei keine wirkliche Rolle. Für die semantische Apokalypse muss KI-Kunst nicht genauso gut sein wie die beste von Menschen geschaffene Kunst. Es reicht aus, eine Flut nahezu identischer Werke in die Welt zu schicken, um die Ausdruckskraft der Originale zu schmälern.

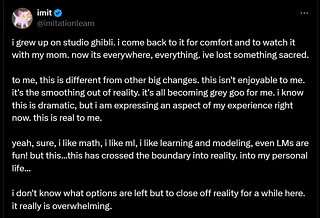

Viele berichten in sozialen Medien von einem veränderten mentalen Verhältnis zu Kunst. Denn obwohl das ungehemmte Ghiblifizieren Spaß macht, verliert das Original damit ganz grundsätzlich an Wert. Hier beschreibt eine Person ihre persönliche innere Reaktion auf dieses kulturelle „Grey Goo“.

Erste mentale Anzeichen der semantischen Apokalypse, die meines Erachtens dieselben neurowissenschaftlichen Prozesse wie die semantische Sättigung durchläuft.

Das weit verbreitete psychologische Phänomen der semantischen Sättigung kann ausgelöst werden, wenn ein Wort unablässig wiederholt wird, bis es seine Bedeutung verliert. Eine solche Wirkung lässt sich mit jedem Wort erzeugen. Wie wäre es mit „Ghibli?“

Lesen Sie einfach ohne Pause: Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Lesen Sie einfach weiter, Wort für Wort. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli. Ghibli.

Sagen Sie es laut vor sich hin. Ghiiiiiiiii-bliiiiiii. Ghibli. Ghibli. Ghibli. Ghibli.

Wenn Sie dies oft genug tun, verliert das Wort seine Bedeutung. Ghibli. Ghibli. Ghibli. Ghibli. Es erscheint plötzlich fremd und ungewohnt. Ghibli. Ghibli. Ghibli. Ghibli. Es ist nichts. Nur Buchstaben. Töne. Ein „Ghib“. Dann ein „Li“. Ghibli. Ghibli. Ghibli. So wie Ihnen das Gesicht Ihres Kindes plötzlich fremd erscheint. Ghibli. Ghibli. Ghibli. Ghibli. Es bleiben nur die Einzelteile des Wortes. Ghibli. Ghibli.

Semantische Sättigung auf kultureller Ebene

Niemand kann genau erklären, wie sich der Prozess der semantischen Sättigung vollzieht. Es wird vermutet, dass ein Mechanismus der neuronalen Gewöhnung einsetzt, bei der Neuronen weniger stark auf einen wiederholten Reiz reagieren. Sie ermüden wie ein Muskel und schütten nach einem Aktionspotential weniger Neurotransmitter aus, bis von ihrem ehemals starken Signal nur noch ein leises Quietschen übrig bleibt. Man geht davon aus, dass sich das Signal aus diesem Grund nicht mehr über die Sprachverarbeitungszentren verbreiten und wie gewohnt alle Standardassoziationen auslösen kann, die in den Begriffsnetzen unseres Gehirns miteinander verflochten sind. Zurück bleibt nur die eigentliche sensorische Information, die offenbar nicht viel mehr ist als in einem bedeutungslosen Zusammenhang geäußerte Silbenlaute. Ghibli. Ghibli. Ghibli. Aber es gibt auch Hinweise darauf, dass es sich um mehr als nur neuronale Ermüdung handeln könnte. Die semantische Sättigung lässt vermuten, dass es eine höhere Ebene innerhalb der neuronalen Netze gibt. Es geht nicht nur um „müde Neuronen“. Bei ausreichender Wiederholung verschiebt sich unsere Aufmerksamkeit zudem von den semantischen Inhalten und konzentriert sich ausschließlich auf die Syntax. Ghibli. Ghibli. Das Wort bezeichnet nur noch sich selbst. Ghibli.Die von der KI angestoßene semantische Apokalypse ist eine Art semantische Sättigung auf kultureller Ebene. Denn was diese Modelle letzten Endes am besten beherrschen, ist Imitation als Form der Wiederholung. Wiederholung im großen Maßstab. Ghibli. Ghibli. Ghibli. Eine aus konzeptueller Sicht ausreichend schnell aufeinanderfolgende Wiederholung. Ghibli. Ghibli. Auch eine nicht völlig perfekte Kopie kann die gewünschte Wirkung erzielen. Ghebli. Ghebli. Ghebli. Ghibli. Ghebli. Ghibli. Und auf diese Weise wird Kunst – und damit meine ich alles, das gesamte künstlerische Schaffen der Menschheit – zu einer gesättigten Sache, bedeutungslos, reine Syntax.

Im Zusammenhang mit KI bereitet mir das, zumindest in unmittelbarer Zukunft, die größten Sorgen. Nicht die Gefahr einer die Welt verschlingenden Superintelligenz (sie meistert noch nicht einmal Pokémon, ein Spiel, das viele von uns mit zehn Jahren beherrscht haben). Sondern eher eine kaum merkliche Apokalypse. In der die Kultur denselben Zusammenbruch erfährt wie die Gemeinschaft, auf dem Rücken eines flirrenden kalkulierten Überschusses an Imitationskraft aus dem Silicon Valley. Ein Überangebot, das uns auf kultureller Ebene sättigt, bis wir uns ganz von der semantischen Bedeutung lösen und nur noch die billigen Einzelteile seiner Struktur wahrnehmen. Ist die Sache einmal bloßgestellt, verlieren wir jeglichen Bezug zu ihr. Es bleiben nur Pixel. Nur Silben. Zwar in einer bestimmten Ordnung. Aber wen interessiert das schon?