La escritora y abogada especialista en derechos humanos Maureen Webb explica cómo las

soluciones tecnológicas pueden reforzar la discriminación, y cómo los hackers luchan por

conservar los derechos democráticos fundamentales en el espacio digital.

En su libro “Coding Democracy” (“Codificando la democracia”) usted describe a los hackers como perturbadores productivos que luchan contra la vigilancia, la concentración del poder y el autoritarismo. Argumenta que los hackers podrían ayudarnos a superar la “disforia informativa” que en este momento padece la sociedad. ¿A qué se refiere?

La disforia informativa se refiere al malestar que estamos enfrentando precisamente ahora en Occidente, el estado de desorientación que sentimos en un mundo digital en el que la información que recibimos y nuestras relaciones sociales están dominadas cada vez más por fuerzas invisibles. Es una calificación más neutra que la de noticia falsa, información defectuosa, desinformación, parcialidad o discriminación, aunque incluye todos estos problemas. En patología, “disforia” se refiere a un estado de angustia, depresión y de –algo que yo creo que en nuestra situación política actual es muy importante– “impaciencia en la afección”.

¿Cuáles son esas “fuerzas invisibles” de las que usted habla?

Hay muchos ejemplos: algoritmos que toman decisiones opacas y nos clasifican socialmente. El Big Data con todas sus conjeturas no comprobadas y que van asumiendo cada vez más funciones de gobierno. Coberturas limitadas, debido a las cuales los medios se dirigen a fragmentos cada vez más pequeños de la sociedad. La microfocalización política, tal como la vimos en el escándalo de Cambridge Analytica vinculado a las elecciones presidenciales de los Estados Unidos de 2016 y al plebiscito sobre el Brexit. Campañas de influencia (campañas en las redes sociales que están orientadas a influir en las opiniones y decisiones de las personas) que ocultan su verdadero origen. Campañas de desinformación virales, el aumento de deepfakes… para nombrar sólo algunos ejemplos.

¿Hasta qué punto la disforia informativa se utiliza como táctica política?

La democracia necesita un discurso equilibrado, basado en hechos. Poner a la población en un lugar de disforia informativa es una vieja táctica de los regímenes autoritarios, una táctica que, reforzada gracias a los medios digitales, en los últimos años también se ha infiltrado en las democracias occidentales. Se inunda el espacio público con falsedades y se generan discursos contradictorios todo el tiempo. Entonces ya nadie sabe qué es verdad y los poderosos están en posición de establecer los símbolos del día. Los símbolos eluden el debate y discurso, porque tocan directamente los emociones de las personas, sus preocupaciones, sus valores, igual que los mitos de pérdida y de redención. La disforia informativa también se aplica para generar censura y vigilar a las masas. A fin de “arreglar” el espacio informativo, los gobiernos y las élites comienzan trabajar en conjunto con plataformas monopólicas, para tener control sobre lo que la población puede oír, pensar o decir. Eso destruye el discurso y la democracia.

¿También los menos poderosos utilizan la disforia informativa?

Se podría decir que una táctica de la resistencia política es poner a la élite dominante en un estado de disforia informativa. En una serie de entradas de blog que escribió antes de empezar con WikiLeaks, Julian Assange explicó su teoría de que la filtración (en especial la de grandes dimensiones) tiene un carácter emancipatorio. No solo porque revela secretos que los ciudadanos deben conocer, sino también porque ahoga y perturba la comunicación entre los poderosos.

Los grupos de hackers como el Chaos Computer Club (CCC) de Alemania luchan desde hace tiempo contra la vigilancia y por más transparencia, ¿no es cierto?

Sí, y han usado otra brillante técnica de perturbación: ¡el humor! Por ejemplo, lo hicieron cuando muchos gobiernos, al comienzo de la “guerra contra el terror”, quisieron introducir documentos de identidad biométricos. Ahí el CCC robó la imagen de las huellas digitales del ex ministro del interior alemán Wolfgang Schäuble y la publicó en una revista, impresa en un film plástico, de modo que los lectores podían usarla para pasar como ministro en los controles de seguridad. Fue un método que tenía mucho humor y sirvió para mostrar las debilidades de esos sistemas y para influir en la percepción que tiene la población –y los ministros– de esos sistemas.

¿Cómo se manifiestan en las tecnologías digitales la parcialidad y la discriminación?

Observemos un ejemplo muy debatido: los algoritmos que nos rodean y deciden quién obtiene un crédito, una oportunidad laboral o un seguro y a qué precio. Esos algoritmos no son automáticamente honestos. Muy a menudo reproducen sin ningún tipo de examen el prejuicio y la discriminación. En el mundo analógico hemos desarrollado diferentes métodos para hacer visibles esos prejuicios y abordarlos. Pero en el mundo digital, por lo general, el código está en una “caja negra” y son pocas personas las que saben qué ocurre exactamente en esa caja. Y en el caso del aprendizaje automático, a veces hasta los programadores ignoran lo que pasa.

¿Podría darnos algún ejemplo de cómo la parcialidad digital influye en las decisiones y la vida de la personas?

En determinado momento, Amazon comenzó a usar un algoritmo para contratar ingenieros de software y más tarde quedó demostrado que el mecanismo elegía exclusivamente a los postulantes varones. La razón era que para determinar los criterios de empleo se usaban los currículums de los ingenieros que ya estaban trabajando en Amazon. El prejuicio ya estaba en los datos históricos y el algoritmo lo reprodujo.

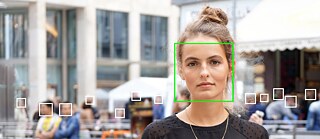

¿Podría pasar lo mismo con las tecnologías que usan los gobiernos, por ejemplo, los programas de reconocimiento facial?

Un estudio que investigó dos grandes programas de reconocimiento facial encontró que, si se trataba de un varón blanco, los programas sólo fallaban en la atribución de sexo en el 1 por ciento de los casos. Pero si se trataba de una mujer de piel oscura, el porcentaje de error era del 35 por ciento. El motivo es que los programadores alimentaron el algoritmo con un grupo de datos compuesto por personas que tenían el mismo aspecto que ellos. Es muy preocupante pensar que nuestro sistema penal y otro sistemas coercitivos confían cada vez más en algoritmos para tomar decisiones y que en un sistema completamente automatizado no hay recursos judiciales, no hay juicio humano, ni perdón o discreción.

¿Por qué no hay más resistencia pública contra la aplicación de tecnología discriminatoria?

Por un lado, porque todo el proceso se da de modo oculto y se lo comprende poco. Además, los seres humanos somos impacientes: deseamos una herramienta mágica que solucione todos los problemas, y estamos siempre demasiado prontos a reaccionar con impulsos conservadores. Y eso nos ocurre a todos. Debemos tener el valor para observar esos fenómenos de modo imparcial. Pienso que es muy importante que los progresistas reconozcan que también son parciales. La censura por medio de los algoritmos de búsqueda es el arma preferida para oponerse a las opiniones, preguntas y debates que no agradan a los progresistas. Hablo aquí como persona de izquierda, sindicalista y abogada de derechos humanos. Hay situaciones en las que pensamos que estamos haciendo lo correcto pero en realidad estamos causando daños.

¿Por ejemplo?

Por ejemplo, en Hollywood había una aplicación que tenía como objetivo combatir la discriminación de los negros en la industria cinematográfica. La aplicación comenzó como un sencillo banco de datos de personas negras que trabajan en el rubro. El paso siguiente que habían planeado los desarrolladores era elaborar un desglose demográfico de la pertenencia étnica de los empleados de cada producción cinematográfica. En una conferencia que di en el Goethe-Institut San Francisco, argumenté que eso podía ser una idea muy mala desde el punto de vista de los derechos humanos y laborales.

¿Cuál era el problema con esa aplicación?

Yo estoy absolutamente a favor de una mayor participación de minorías en todos los niveles del ámbito laboral. Pero en aquella ocasión tuve que preguntar: si ustedes ofrecen un desglose demográfico, ¿qué categorías usarán? ¿No sólo etnia, sexo sino también, familia, religión y posición socioeconómica? Los derechos humanos protegen esos datos. ¿El objetivo de ustedes es una participación proporcional? ¿Y cómo puede alcanzarse esa participación si cada ser humano tiene diferentes marcas identitarias que se superponen y juntas dan más que cien por ciento? Además, los empleados tienen derecho a la privacidad. Hay muchas razones por las cuales ellos no querrían informar a sus empleadores de todos los elementos componentes de su identidad. Y está el miedo de ser descartado, si los estudios saben que uno tiene una discapacidad o antecedentes penales. Eso nos plantea la siguiente pregunta: ¿qué pasa con los que no quieren colaborar? ¿Ustedes quieren realmente obligar a todos los empleados a llevar consigo un documento de identidad –un documento de identidad racial– sólo porque nuestra sociedad de información está en condiciones de construir un sistema así? Si nos entregamos a “soluciones técnicas”, lo que comienza como una idea buena, progresista puede convertirse muy rápido en una solución mala con consecuencias indeseables.

Con el certificado de vacunación, los gobiernos progresistas justamente han introducido recientemente una “solución técnica”. ¿Podría tener consecuencias indeseables?

Ese es otro ejemplo significativo de cómo los progresistas olvidan demasiado fácilmente la propia falta de imparcialidad. En un lapso de tiempo brevísimo los gobiernos occidentales (confiando en la propia virtud e inteligencia superior) hicieron que grandes porciones de la sociedad aceptaran una vigilancia masiva y un sistema de créditos sociales que siguen el modelo chino. Si esos gobiernos hubieran perseguido objetivos legítimos en el campo de la salud pública, habrían podido usar documentos, temporales con protección contra la falsificación, igual que los billetes, los carnets de conducir o las tarjetas del seguro. En cambio, se decidieron por una aplicación con un código QR, que guarda datos personales y médicos. Construyeron un sistema sin igual en Occidente, que probablemente se extenderá en el tiempo y ampliará sus contenidos. Lo que quiero decir es que, si están en manos de cualquiera, las herramientas digitales que nos clasifican socialmente pueden resultar peligrosas. Son herramientas de control social que funcionan con lógica mecánica y sin sensibilidad humana, y su aplicación tiene consecuencias que en muchos casos van mucho más lejos de lo que pensaban sus creadores. Mi consejo imperioso: ten cuidado con lo que creas. La sociedad debe sopesar bien qué sistemas está creando.

Si están en manos de cualquiera, las herramientas digitales que nos clasifican socialmente pueden resultar peligrosas. Son herramientas de control social que funcionan con lógica mecánica y sin sensibilidad humana, y su aplicación tiene consecuencias que en muchos casos van mucho más lejos de lo que pensaban sus creadores.

En su libro sostiene que precisamente son los hackers los que encuentran las mejores soluciones para estos desafíos democráticos.

Pienso que los hackers están en el camino correcto, más que otros grupos. Y no pienso que una solución técnica estrecha nos pueda sacar de la miseria. Los hackers luchan desde hace tres décadas por principios fundamentales de gobierno y ética en la época digital. Los hackers progresistas buscan poder compartido, decisiones compartidas y democracia compartida. Quieren acceso libre a Internet, descentralización y soluciones comunitarias o como se dice en inglés, commons-based solutions. Su postulado más importante, conocido como “imperativo práctico” es que el acceso a todo lo que podría enseñarles a los hombres cómo funciona el mundo debería ser ilimitado. Eso significa que todos tendrían que tener la posibilidad de analizar, modificar y mejorar los sistemas informáticos.

¿Se podría decir que los hackers son por naturaleza escépticos respecto a los sistemas, porque saben que todos los sistemas pueden derivar en abusos?

Sí, me parece una observación muy pertinente.

Volviendo a los principios de los que acabamos de hablar. Usted parece apoyarse en la “ética del hacker”, tal como la describió Steven Levy hace casi cuarenta años, irónicamente en 1984.

Sí, hay toda una genealogía de ideas por el estilo que desarrollaron los hackers y que se remontan a los años cincuenta. Levy las resumió en los años ochenta y todavía hoy los hackers las siguen reelaborando. Hoy la “ética de los hackers” incluye principios vinculados a la esfera privada y la autodeterminación de los datos, a la transparencia, la neutralidad en Internet, el software libre y también, obviamente, al “imperativo práctico”. Esos principios son la clave para conservar la democracia en la época digital y superar la disforia informativa.

Una consigna de los hackers que tal vez conozcan nuestros lectores dice “Privacidad para los débiles, transparencia para los poderosos”. ¿Por qué los hackers piensan que es tan importante como tema la privacidad para los débiles?

La privacidad garantiza autonomía y seguridad en la vida privada. Si se quiere proteger a las personas del microtargeting y las campañas de desinformación, hay que proteger su privacidad y darles el control sobre sus datos personales, de modo que no se pueda hacer mal uso de esos datos. Los hackers trabajan desde hace años en herramientas civiles de encriptación para posibilitar la autodeterminación de datos.

¿Y la transparencia para los poderosos?

La transparencia es el antídoto contra los gobiernos fallidos y corruptos. Wikileaks introdujo una época de una transparencia para los poderosos nunca vista. Muchas otras plataformas de filtraciones siguieron este ejemplo, incluso aquellas que hoy son utilizadas por las organizaciones de medios dominantes.

¿Y qué sucede con los otros principios de la ética de los hackers?

En Internet originalmente había neutralidad, porque la red estaba descentralizada y no monitoreaba ni controlaba ni a los usuarios o los contenidos. Cualquiera podía usar Internet para sus propios objetivos, no había ningún guardián. Lo que deberían entender las personas es que la lucha de los hackers por la neutralidad de la red es una lucha por la comunicación libre en la época digital.

Usted también ha mencionado el “software libre”.

Software libre no se relaciona con “libre” en el sentido de “gratis”. Tiene que ser libre en el sentido de que se lo puede probar, modificar, compartir y mejorar sin restricciones. Lo mejor es que no haya ninguna “caja negra”. La idea de que los usuarios controlen el software y no al revés es un fundamento de la libertad y la democracia en el espacio digital.

La idea de que los usuarios controlen el software y no al revés es un fundamento de la libertad y la democracia en el espacio digital.

Para su libro participó del Chaos Communication Camp organizado en Berlín por el CCC y también visitó a hackers en España e Italia. ¿Hay diferencias entre la escena de hackers europea y sus pares del otro lado del Atlántico?

Tuve el honor de conocer hackers de muchos países diferentes, y había claras diferencias entre los países, pero especialmente entre europeos y estadounidenses, y esto aunque haya una internacionalización cada vez mayor de la escena de los hackers. Mi impresión fue que los europeos –especialmente los alemanes– son más serios y temerarios que los estadounidenses. Una acción temeraria, pero políticamente seria como la publicación de las huellas digitales de un ministro no se podría esperar de un grupo estadounidense. Y además, el chiste en sí no habría sido tan bien recibido como en Alemania.

¿En qué más se diferencia la escena de hackers estadounidense?

La escena estadounidense hoy se ha vuelto muy comercial. Muchos hackers son reclutados por el ejército o las agencias de seguridad, por empresas de Big-Tech, o incluso por el Partido Demócrata. Las conferencias de hackers como Defcon y Black Hat están muy orientadas a lo comercial. Y en 2013 se llegó a que un representante de las autoridades estadounidenses encargadas de la seguridad del país diera la ponencia de apertura de Defcon. Muchos de los que en los Estados Unidos se llaman a sí mismos hackers no se preguntan por las consecuencias sociales de su tecnología.

¿La escena europea tiene consciencia social y democrática?

En España, Francia e Italia sin lugar a dudas. También los hackers alemanes como el CCC siempre han abordado la relación entre tecnología y sociedad. Y se pueden observar grandes avances. Igual que el Congreso Nacional Africano de Mandela, la reputación del CCC cambió con el tiempo. De la sospecha de criminalidad se pasó a la seriedad. Hoy es un un grupo apreciado al que consultan con regularidad el parlamento alemán y el parlamento europeo.

¿Cómo describiría el futuro del movimiento de hackers?

La escena progresista de hackers se convertirá en una comunidad internacional que crecerá. Ya está cada vez más conectada con grupos ciudadanos que abordan todos los temas de los que hemos hablado hoy. Los hackers también intentan aplicar sus capacidades y su visión tecnológica para afrontar los problemas que vivimos actualmente. El desafío democrático es ahora conservar los principios liberales de Occidente y al mismo tiempo alcanzar un consenso amplio. Eso podría lograrse con modelos de democracia compartida y poder de decisión compartido, que proponen algunos grupos de hackers.

febrero 2022