KI neu denken als Gemeingut

Obwohl KI häufig als „Zukunft“ oder „vierte industrielle Revolution“ bezeichnet wird, gibt es noch immer eine erhebliche Wissenskluft zwischen KI-Expert*innen und Alltagsnutzer*innen. Viele von ihnen verstehen nicht, wie KI funktioniert, oder wissen nicht einmal, was „Open-Source-KI“ bedeutet. In der heutigen globalen Tech-Landschaft ist KI alles andere als neutral. Sie wirkt als kulturelle Kraft, indem sie unsere Wahrnehmung und Beurteilung der Welt beeinflusst. Aktuelle Modelle stützen sich eher auf eine probabilistische Mustererkennung als auf das wirkliche Erfassen eines Sachverhalts. Sie replizieren dominante kulturelle Narrative und verstärken vorhandene Vorurteile, indem sie die gängigsten Muster in ihren Trainingsdaten reproduzieren. Auch wenn auf diese Weise die Akzeptanz allgemein anerkannter Tatsachen gesteigert werden kann, können sich daraus Probleme in politischen Entscheidungsprozessen, in der Bildung oder im öffentlichen Diskurs ergeben, wo differenzierte oder marginalisierte Perspektiven ohnehin unterrepräsentiert sind.

Tech-Unternehmen und politische Entscheidungsträger*innen versuchen in der Regel, solche Vorurteile mit Regelungen zu „beheben“ – allerdings definieren verschiedene Kulturen Sexismus, Rassismus und Diskriminierung auf ganz unterschiedliche Weise. Kann es in einer globalisierten Welt, in der Datensätze Kontexte miteinander vermischen, jemals eine allgemeingültige Definition eines Vorurteils geben? Ist eine universelle KI überhaupt möglich – oder haben wir es bald mit zahlreichen „pluriversalen“ KI zu tun, die sich auf unterschiedliche Wertesysteme beziehen?

Darüber hinaus ist KI eng mit dem Kapitalismus verstrickt, der die Branche am Laufen hält und von ihr befeuert wird. Häufig werden nicht nur die materiellen Kosten der KI übersehen – wie Strom, Wasser, seltene Erden –, sondern auch die menschlichen Kosten, beispielsweise durch die Ausbeutung von Arbeitskräften im Globalen Süden. Weil die Kontrolle über die KI-Entwicklung in den Händen einiger weniger mächtiger Konzerne und Nationalstaaten liegt, werden bestehende soziale Hierarchien weiter verstärkt und vulnerable Gruppen wie Women of Colour, nicht-binäre und zuwandernde Menschen oder Geflüchtete in vielen Fällen benachteiligt. Die generative KI bringt dieses Ungleichgewicht zum Vorschein, da Bildgeneratoren häufig auf westzentrische Ästhetiken zurückgreifen und demzufolge die Vielfalt der Lebenserfahrungen nicht zeigen. Diese Einschränkungen machen deutlich, dass es dringend alternativer, commons-basierter Ansätze bedarf, um mehr Diversität bei den Perspektiven und Ergebnissen der KI zu gewährleisten.

Damit sind einige grundlegende Fragestellungen verbunden: Wer profitiert von KI? Wer entscheidet, welche Daten rechtmäßig für KI-Trainingszwecke genutzt werden können? Wessen Sicherheit haben Regierungen und Konzerne bei ihrem Versprechen einer „ethischen KI“ im Blick? Wenn KI mehr als nur ein Werkzeug ist, tragen die Menschen dann eine ethische Verantwortung für KI? Diese strittigen Punkte machen deutlich, dass es bei KI nicht nur um Technologie geht, sondern auch um Menschlichkeit, Gerechtigkeit und die Frage, wie wir die Welt gestalten wollen. Für das Training der KI sind globale Dialoge über Ethik, Macht und Verantwortung unerlässlich.

Globale KI-Governance

Vor dem Hintergrund von Sicherheitsbedenken konzentrieren sich einige Regierungen inzwischen auf eine internationale Zusammenarbeit im KI-Bereich. Zum Abschluss des ersten KI-Sicherheitsgipfels in Großbritannien 2023 unterzeichneten 29 Staaten die Bletchley-Erklärung zur Förderung einer sicheren und verantwortungsvollen KI. Südkorea lud als einer der Schlüsselakteure 2024 zum KI-Gipfel nach Seoul, auf dem sich zehn Staaten gemeinsam mit der EU zur Einrichtung staatlich geförderter KI-Sicherheitsinstitute und zu einer globalen Koordinierung verpflichteten.Seitdem hat Südkorea sein Engagement für Sicherheit und Inklusivität mit der Einrichtung eines nationalen KI-Sicherheitsinstituts untermauert. Allerdings verlagerte der dritte Gipfel in Frankreich 2025 den Schwerpunkt von Sicherheit auf Wettbewerb und äußerte sich skeptisch darüber, ob die globale Governance dem Druck durch ein KI-Wettrüsten standhalten könne. Es besteht die Gefahr, dass ethische Belange im Wettlauf der Nationen um eine Vorherrschaft auf den KI-Märkten an dem Rand gedrängt werden, insbesondere in Ländern mit begrenzter Infrastruktur, die häufig eher zu Quellen für günstige Arbeitskräfte als zu Innovationszentren entwickeln.

Südkorea: Souveräne KI und ethische Herausforderungen

Mit seiner Strategie „erst Technologie einführen, dann regulieren“ ist Südkorea innerhalb kürzester Zeit zu einem wichtigen KI-Zentrum geworden. Sein beschleunigtes Vorgehen macht deutlich, wie viel Druck auf Ländern außerhalb der EU, USA und China lastet, Schritt zu halten im globalen KI-Wettrennen, in dem die Nutzung der KI oftmals als Messwert für den Entwicklungsstand einer Nation gilt.Koreanische Tech-Giganten bemühen sich zurzeit mit Nachdruck um die Entwicklung von KI und Datensouveränität. Naver will mit seinem Modell HyperCLOVA X, das deutlich stärker als GPT-4 mit koreanischen Daten trainiert wird, eine KI anbieten, die „sieht, hört und spricht wie ein Mensch aus Korea“. Dies wirft allerdings auch kritische Fragen auf: Wessen Stimmen und Werte repräsentiert eine solche KI? In koreanischen Online-Räumen werden häufig frauenfeindliche Haltungen vertreten, gegen die sich wiederum feministische Bewegungen aktiv zur Wehr setzen. Es bedarf daher dringend ethischer und inklusiver Ansätze, weil Südkorea den flächendeckenden Einsatz von KI beschleunigt vorantreibt.

Gender Bias und ethische Bedenken

Gender Bias und ethische Aspekte spielen in der koreanischen KI-Landschaft eine wichtige Rolle. Feministische Gruppen und Rechtsexpert*innen beklagen, dass es keine zuverlässigen ethischen Rahmenbedingungen gibt – ein Makel, der angesichts aktueller Kontroversen unmöglich ignoriert werden kann.Im Jahr 2019 kam es zu einem großen öffentlichen Aufschrei gegen die sexistischen Antworten des interaktiven Sprachassistenten von Korea Telecom. Zwei Jahre später gab es empörte Reaktionen auf den Chatbot Iruda, der private Unterhaltungen ohne Zustimmung verwendet und rassistische, sexistische und homophobe Inhalte produziert hatte. Erst kürzlich verlieh eine Welle von Deepfake-Pornografie an koreanischen Schulen den Forderungen nach einer strengeren Kontrolle zusätzliche Dringlichkeit.

Südkorea führte unlängst Maßnahmen zur Bereitstellung eines einheitlichen KI-Rahmens ein, darunter das KI-Gesetz „AI Basic Act“ von 2020 sowie das Förderprogramm für einen digitalen KI-Leitfaden von 2023 (das nach der Amtsenthebung des ehemaligen Präsidenten Yoon Suk-yeol wegen Machtmissbrauchs wieder zurückgenommen wurde). Allerdings stießen diese Initiativen wegen vermeintlicher Vorurteile und Eingriffe in die Privatsphäre und verfassungsmäßigen Rechte auf Kritik. Die öffentliche Empörung schlug besonders hohe Wellen, als die von Südkorea als souveränes Territorium betrachtete Insel Dokdo in einem KI-Lehrbuch als „Gegenstand territorialer Streitigkeiten“ mit Japan bezeichnet wurde, was der Haltung der japanischen Regierung in dieser Frage entspricht – ein Vorfall, der die Gefahren von Falschinformationen und kulturellen Vorurteilen im Bereich der KI-gesteuerten Bildung deutlich hervorhebt.

Die beschriebenen Fälle vermitteln eine klare Botschaft: Angesichts der Tatsache, dass Südkorea die Einführung von KI forciert, darf ethische Governance nicht als Nebensache abgetan werden. Ohne wirksame Schutzmaßnahmen läuft die KI Gefahr, schädliche Stereotypen zu verstärken und vorurteilsbehaftete Narrative zu verbreiten – sowohl im Internet als auch im Klassenzimmer.

Warum community-basierte KI wichtig ist

Nach jahrelangen Debatten verabschiedete Südkorea im Dezember 2024 mit dem „AI Basic Act“ als zweiter Rechtsraum nach der EU eine umfassende KI-Gesetzgebung. Das Gesetz spiegelt das Streben des Landes nach einer KI-Führungsrolle als Faktor für nationale Sicherheit und wirtschaftliche Wettbewerbsfähigkeit wider. Obwohl es Bestimmungen zu Sicherheit, Transparenz und Datenschutz enthält, weist es noch einige eklatante Lücken auf, zum Beispiel bei der Regulierung von Online-Plattformen, die noch immer schädigende KI-generierte Inhalte (z. B. Deepfake-Pornografie) verbreiten. Weltweit herrscht nach wie vor Uneinigkeit darüber, welche Daten einer Regulierung bedürfen und welchen Einfluss Regierungen auf den Einsatz von KI nehmen sollten. Diese Fragen sind trotz des ungezügelten KI-Booms noch nicht gelöst.Vor diesem Hintergrund wirft die KI einige grundlegendere Fragen auf: Wie würde eine von Unternehmen wie Naver propagierte souveräne, nicht-westliche KI aussehen? Können solche Systeme die Reproduktion kolonialer und patriarchaler Strukturen verhindern, die in lokale und globale Datensysteme eingebettet sind? Souveräne KI-Projekte müssen nicht nur auf die Verwendung westlicher Datensätze verzichten, sondern sich auch mit dem Einfluss von Kolonialgeschichten auf lokale Wissenssysteme und soziale Hierarchien auseinandersetzen. Koreanische Online-Räume, die in vielen Fällen frauenfeindliche Tendenzen aufweisen, funktionieren innerhalb patriarchaler Strukturen, die von der japanischen Kolonialherrschaft und dem Neokolonialismus der USA geprägt wurden. Im Sinne des dekolonialen Feminismus bestimmen Kolonialismus und Patriarchat als miteinander verschränkte Systeme unverändert das Machtgefüge.

Kann eine mit koreanischen Online-Diskursen trainierte KI wirklich dazu beitragen, die Repräsentation zu dekolonisieren – oder läuft sie Gefahr, die Diskriminierung zusätzlich zu verstärken? Diese Problemstellung erfordert eine intersektionalen Strategie im Bereich der KI-Governance, die Aspekte von Gender, Race und weltweiten Ungleichheiten berücksichtigt und gleichzeitig Gemeinschaften darin unterstützt, die technologische Entwicklung unter inklusiven und ethischen Gesichtspunkten zu fördern.

KI als Gemeingut

Die Ethik der Künstlichen Intelligenz fokussiert sich zunehmend auf alternative Formen des Modelltrainings und der Gewinnung von Trainingsdaten. Die meisten aktuellen Modelle basieren auf großen Datensätzen aus dem Internet, die häufig ohne Zustimmung „geschürft“ wurden – eine Praxis, die mit schwerwiegenden ethischen Bedenken verbunden ist. Die Forschung unterscheidet zwischen Daten, die zur Verfügung gestellt werden, und „Capta“, also Daten, die aufgezeichnet und bearbeitet werden, um die Notwendigkeit von KI-Transparenz und einer Zustimmung zur Datennutzung zu unterstreichen.Vor diesem Hintergrund plädieren die Befürworter*innen einer „KI als Gemeingut“ dafür, Künstliche Intelligenz als gemeinsame kulturelle Ressource zu betrachten, die von der Öffentlichkeit geprägt wird. Ein solcher Ansatz versetzt unterrepräsentierte Stimmen und lokale Gemeinschaften in die Lage, die Technologie auf inklusive und transparente Weise zu beeinflussen, anstatt die Kontrolle allein den Unternehmen und Staaten zu überlassen.

Das LoRA Training Toolkit* leistet einen praktischen Beitrag zur Verwirklichung dieser Zielsetzung. Es bietet Gemeinschaften die Möglichkeit, kuratierte, ethisch unbedenkliche lokale Daten in KI-Systeme zu übertragen, um Vorurteile abzubauen und diversere Ergebnisse zu erzielen. Auch wenn eine solche Praxis das Wirtschaftssystem nicht ändern wird, kann sie doch das Bewusstsein für die sozialen Folgen der KI schärfen und die demokratische Teilhabe durch eine Einbindung von Nicht-Fachleuten in das Modelltraining stärken.

Workshop an der Yonsei University

Als Ausgangspunkt für diesen praktischen Beitrag dienen Initiativen wie die AI and the Commons Plattform von Open Future. Gemeinsame Ressourcen werden hier aus einer ethnografischen Perspektive betrachtet, wie es der Anthropologe Massimiliano Mollona in Art/Commons: Anthropology Beyond Capitalism (2021) vorschlägt. Mollona zeigt in seinem Essay, wie Kunst als kollaborative Praxis genutzt werden kann, um gemeinsam Wissen zu kreieren und Kreativität eher zum Erhalt des Gemeinguts als zur Erwirtschaftung von Gewinnen zu nutzen.Inspiriert von diesem Konzept trafen sich im Dezember 2024 Künstler*innen, Wissenschaftler*innen und Aktivist*innen an der Yonsei University in Seoul, um sich näher mit dem Einsatz partizipativer Open-Source-Methoden in lokalen KI-Maßnahmen zu befassen. Die Wissenschaftler*innen Seoyoung Choi und Miro Leon Bucher stellten den Teilnehmer*innen die „kritische Einspeisung von Daten“ als Möglichkeit vor, dominante Narrative durch das Training eigener Modelle mit kulturspezifischen Daten aus Südkorea zu hinterfragen.

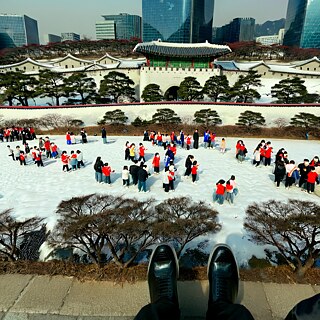

Im ersten Experiment des Workshops erstellten die Teilnehmer*innen mit dieser Methode ein realistischeres „Foto von Seoul“, als es auf den üblichen KI-generierten Bildern von der koreanischen Hauptstadt zu sehen ist. Es ging darum, eine andere Stadt zu zeigen als die gängigen KI-generierten Hochglanzbilder von Wolkenkratzern in einer makellosen, modernen Skyline, die dem offiziellen Tourismusmarketing für eine geordnete, wohlhabende, hypermoderne Metropole entsprechen.

Auf diesen Standardbildern lässt sich nicht nachvollziehen, welche Lebensrealitäten und sozialen, politischen und stadtplanerischen Entscheidungen den Alltag in der Stadt beeinflussen. Studien haben gezeigt, dass der städtische Raum von Seoul maßgeblich von Gender, Klassismus, Race und Ableismus bestimmt wird. KI-generierte Bilder zeigen nur selten, welche Ungleichheiten in dieser Stadt besteht, wie sie Heteronormativität bevorzugt und queere Communities und Menschen mit Behinderungen marginalisiert – und damit Gruppen, die hier schon immer Teil des öffentlichen Lebens waren, wie Veranstaltungen wie die Seoul Pride und jüngste Massenproteste deutlich machen.

Mit einer solchen alternativen Darstellung der Stadt werden auch ihre Bewohner*innen angemessen gewürdigt. Im Verlauf des Workshops machten sich die Teilnehmer*innen Gedanken darüber, wie sich aus den vielfältigen Beziehungen zu der Stadt, die von unterschiedlichen Lebenserfahrungen in den verschiedenen Stadtvierteln und im Alltag geprägt sind, nicht nur eine, sondern mehrere Versionen von Seoul ergeben. Sie tauschten persönliche Narrative miteinander aus und erstellten mit dem für die Studie entwickelten LoRA Training Toolkit eigene Datensätze auf Grundlage gelebter Erfahrungen.

Das Ergebnis waren Bilder, die Seoul als Stadt voller Gegensätze und politischer Möglichkeiten zeigen, als Stadt, die unterschiedliche Dinge für unterschiedliche Menschen bedeutet. Dies widerspricht den gängigen Darstellungen einer vollständig globalisierten, hypermodernen Kapitale und Touristenstadt. Im Unterschied zu den sterilen Bildern der konventionellen KI zeigen diese Bilder der gemeinschaftlich trainierten Modelle Straßenszenen aus den Stadtvierteln und andere typische Alltagssituationen, Protestplakate und Regenbogenflaggen, Kinder und sogar Wildtiere im städtischen Umfeld. Weil für das LoRA-Training Bilder der Teilnehmer*innen verwendet wurden, wichen die KI-Ergebnisse des Workshops deutlich von gängigen Darstellungen ab.

Voraussetzungen und Grenzen

Der Workshop hat gezeigt, dass community-basiertes KI-Training visuelle Narrative erzeugen kann, die sich ganz wesentlich von den mit Unternehmenssystemen produzierten Narrativen unterscheiden. Darüber hinaus vermittelt es einen Eindruck davon, wie commons-basierte KI-Bilder aussehen könnten. Obwohl solche Verfahren nach wie vor durch die in großen Basismodellen enthaltenen Vorurteile eingeschränkt werden, machen sie doch deutlich, dass Gemeinschaften die Repräsentation – selbst im kleinen Maßstab – spürbar beeinflussen können.Eine wirkliche „KI als Gemeingut“ erfordert nicht nur gemeinsame Datensätze, sondern auch wechselseitige, einvernehmliche Beziehungen zwischen den Beteiligten. Die meisten kommerziellen und sogar viele Open-Source-Modelle erfüllen diese Kriterien nicht, weil sie Daten nutzen, die ohne Zustimmung geschürft wurden, und Gewinne mit den Leistungen der Urheber*innen erzielen, deren Material sie verwenden. Ein commons-basierter Ansatz muss kontinuierlich fortgeführt werden und Datensätze und Modelle nutzen, die sich parallel zu den Gemeinschaften durch deren aktive Teilhabe und regelmäßige Neutrainings weiterentwickeln.

Maßnahmen im kleinen Maßstab werden nicht ausreichen, um das KI-Ökosystem von Grund auf zu erneuern. Doch sie schaffen Raum für alternative Möglichkeiten des Sehens – und Gesehenwerdens – in durch KI vermittelten Kulturen. Derartige Initiativen erfordern systemische Maßnahmen zugunsten einer offenen, modularen KI-Infrastruktur, öffentlicher Investitionen und technischer Rahmenbedingungen, um die Integration zahlreicher kleiner Modelle ohne Einsatz eines einzigen Basissystems zu ermöglichen.

Praktische Schritte hin zu einer KI als Gemeingut

Eine „KI als Gemeingut“ klingt nach einem Ideal, doch sie birgt auch Risiken. Denn sogar eine einvernehmliche gemeinsame Datennutzung kann Vorurteile transportieren, weshalb auch gemeinschaftlich erstellte Modelle weiterhin schädliche Ergebnisse produzieren können. Trotzdem hat ein solcher Ansatz klare Vorteile: Im Unterschied zu proprietären Systemen kann eine commons-basierte KI rechtlich kontrolliert werden und gibt ihren Nutzer*innen die Möglichkeit, auf den Einsatz ethisch nicht vertretbarer Modelle zu verzichten.Eine wesentliche Voraussetzung für eine erfolgreiche Umsetzung dieses Konzepts ist die KI-Governance. Bürgerräte, die verschiedene gesellschaftliche Gruppen vertreten, sollten lokale Modelle beaufsichtigen, Mittel verteilen und für Zuverlässigkeit sorgen – nach dem Vorbild des öffentlich-rechtlichen Rundfunks in Deutschland, der zwar unabhängig ist, aber von Aufsichtsgremien kontrolliert wird. Wenn Nutzer*innen die Möglichkeit erhalten, eigene Modelle zu erstellen und zu verwalten, kann sich die KI von einer extraktiven Industrie in einen partizipativen Prozess verwandeln, in dem Beteiligte sowohl die Ergebnisse als auch ethische Kriterien mitgestalten können.

Wie auch Werte und Normen sollte sich die KI kontinuierlich weiterentwickeln. Ein commons-basiertes System begegnet dieser Realität mit einer ständigen Beteiligung, einer regelmäßigen Erneuerung der Datensätze sowie mit Neutrainings, damit die KI den Wandel der Identitäten und ethischen Grundsätze abbildet. In technischer Hinsicht entspricht diese Zielsetzung den „Mixture-of-Experts (MoE)“-Architekturen, die Funktionen wie Bildgenerierung und Sprachverarbeitung in spezialisierten Community-Modellen miteinander verbinden – ohne dafür auf kommerzielle Gatekeeper angewiesen zu sein.

Regierungen und Kultureinrichtungen sollten eine zentrale Rolle übernehmen, indem sie in offene, modulare Infrastrukturen investieren, den Aufbau gemeinschaftlicher Kapazitäten fördern und die Entwicklung ethischer Datensätze im Rahmen von Abkommen über kulturelle Zusammenarbeit, Austauschprogrammen und Stipendien für Projekte zum Thema „KI als Gemeingut“ unterstützen. Praktische Tools wie mobile Storytelling-Labs und LoRA-Workshops können die Beteiligung einer breiteren Öffentlichkeit ermöglichen.

Bildung ist ebenfalls ein entscheidender Faktor: Bildungsprogramme sollten technisch unerfahrene Nutzer*innen dazu befähigen, KI-Modelle zu verstehen, zu trainieren und zu kontrollieren und gleichzeitig feministische und dekoloniale Perspektiven in die KI-Governance zu integrieren. Schließlich bedarf es auch zuverlässiger Mechanismen der Rechenschaftspflicht, damit Gemeinschaften unzensierte schädliche Inhalte kennzeichnen können. Darüber hinaus sollten Regierungen, multilaterale Gremien und Kultureinrichtungen eine Mittlerrolle übernehmen und sichere Räume für ethische Dialoge bieten.

Eine inklusive KI ist nicht nur ein technologisches Ziel, sondern auch eine kulturelle und politische Notwendigkeit. Künstliche Intelligenz ist auf Transparenz, Zustimmung und KI-Governance angewiesen, um vielfältige Erfahrungen abzubilden, systemische Diskriminierung zu bekämpfen und weltweit zu einer nachhaltigeren und friedlicheren Zukunft beizutragen.

* Dieser Artikel basiert auf der Studie „Democratising Artificial Intelligence through Culture“ (Seoyoung Choi, Miro Leon Bucher, © ifa 2025), die im Rahmen des ifa-Forschungsprogramms „Kultur und Außenpolitik“ durchgeführt und unter einer Creative-Commons-Lizenz veröffentlicht wurde (CC BY 4.0). Hier geht es zur Originalstudie (in englischer Sprache).

Autor*innen: Seoyong Choi, Miro Leon Bucher

Redaktion: Leslie Klatte

Englisches Lektorat: Eric Rosencrantz

Deutsche Übersetzung: Kathrin Hadeler

Koreanische Übersetzung: Young-Rong Choo