Ausgesprochen … posthuman

Wie uns Roboter manipulieren

Habt Ihr die AGB gelesen? Nein? In der Kolumne „Ausgesprochen … posthuman“ zeigt Liwen Qin, wie sich unser Verhalten dem einer Maschine anpasst.

Von Liwen Qin

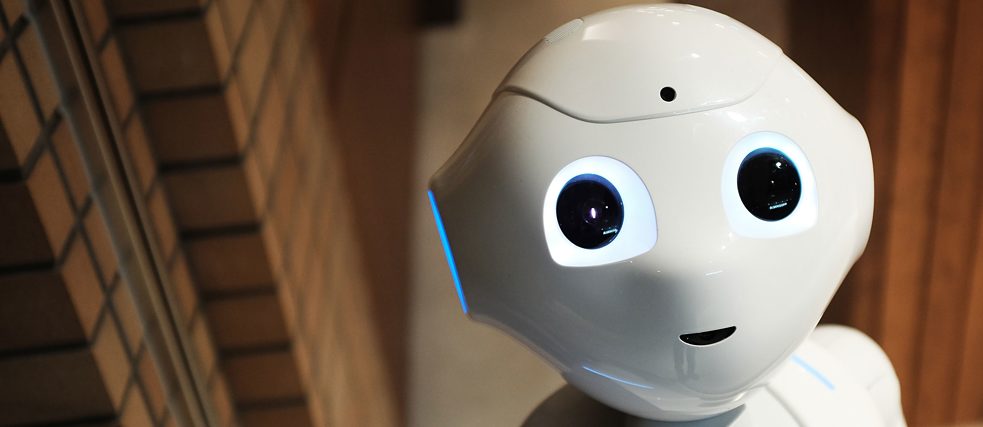

Einmal stand ich alleine im Fahrstuhl des JW Marriot Hotels in Shenzhen, einem der Silicon Valleys von China. Plötzlich öffnete sich die Tür. Ein weißer, vertikaler Zylinder rollte herein, der aussah wie R2-D2 aus Star Wars, nur ohne ohne Arme und Beine. Er begrüßte mich mit einer kindlichen, selbstbewussten Stimme: „Hallo, ich fahre in den 38. Stock.“ Ich war total überrascht, aber voller Freude und Neugier – ich wollte dem Zylinder folgen und sein Freund werden, ihn vielleicht sogar besitzen. Und mir war vollkommen klar, dass ich manipuliert worden war.

Die Sorge um die Entwicklung von Künstlicher Intelligenz (KI) ist übertrieben. Rodney Brooks, einst Leiter des Computer Science And Artificial Intelligence Laboratory im MIT, listet in einem Artikel die „sieben Todsünden” der Prophezeiungen zur Künstlichen Intelligenz auf – und erklärt dort, dass in punkto KI immer noch eine große Lücke klafft zwischen der Wirklichkeit und dem, was die Bevölkerung glaubt.

Keine Chance, nein zu sagen

Computerprogramme wie AlphaGo oder Deep Blue mögen zwar (menschliche) Schachweltmeister geschlagen haben, aber Maschinen lernen längst nicht so effektiv wie Menschen und viel weniger komplex als das menschliche Gehirn, das Informationen aufsaugt wie ein Schwamm. Was uns zurzeit Sorgen machen sollte, ist nicht, dass Künstliche Intelligenz die Welt regieren wird – sondern dass wir Menschen uns der geringeren Intelligenz der Maschinen anpassen, von denen einige so süß scheinen wie R2-D2.Die erste dieser Anpassungen ist ein Verhaltensmuster, das dem einer Maschine ähnelt: Wir klicken auf „Ja, ich akzeptiere die AGB“, ohne dass wir diese je gelesen haben. Wir „liken“ online Videos und füttern damit den Computer mit unseren Vorlieben: Niedlichkeiten oder Witzen. So werden wir zu Datenfütterungsmaschinen und haben dabei oft keine Chance, nein zu sagen.

Verhältnis zwischen Sklave und Herr

Die zweite Art der Anpassung ist ein Anspruchsdenken, das die Beziehung zwischen Menschen beeinflusst. Wenn Menschen eine Art Besitzanspruch auf ein intelligentes Wesen geltend machen, und diese Macht dann missbrauchen, indem sie etwa Alexa anschreien, hat das Einfluss auch auf die zwischenmenschlichen Beziehungen – weil Verhaltensmuster auftreten, die an das Verhältnis zwischen Sklave und Herr erinnern.Und schließlich: Wenn wir zu viel Zeit mit einer „unterwürfigen“ Künstlichen Intelligenz verbringen, hat das negative Auswirkungen auf unsere Fähigkeit, Beziehungen zu unseren Mitmenschen aufzubauen. Darin liegt die dritte Art der Anpassung. Momentan daten über eine halbe Million japanischer Männer eine digitale Figur namens Rinko. Diese „Digisexuals“ entscheiden sich für eine angenehme, kontrollierbare Beziehung mit einer Künstlichen Intelligenz, statt eine komplizierte Beziehung mit einem Menschen einzugehen: eine Beziehung, in der es auch mal Spannungen gibt.

Natürlich sind wir es, die die Künstliche Intelligenz programmieren. Aber nicht jeder kann entscheiden, wie diese genau gestaltet werden soll. Das entscheiden nur die, die festlegen, welches Spiel die Künstliche Intelligenz mit uns treiben soll: Unternehmen und Regierungen.

Moralische und soziale Fragen

Bislang ist die tägliche Überwachung und Manipulation in Deutschland noch weitaus weniger ausgeprägt als in einigen anderen Teilen der Welt, da die Gesellschaft hier noch hohen Wert auf Datenschutz legt. Es liegt allerdings auch daran, dass die IT-Infrastruktur in Deutschland im Vergleich zu Ländern wie den USA oder China noch sehr rückständig ist. Aber das wird sich wohl bald ändern.Ich glaube nicht, dass wir den Kampf gegen die Maschinen verloren haben, wenn der Nutzer sich seiner Beziehung zur Künstlichen Intelligenz bewusst ist, und wenn die KI-Entwickler stets im Hinterkopf behalten, dass Funktionen erst im Hinblick auf moralische, soziale und historische Fragen geprüft werden müssen, bevor sie in menschliche Hände gelangen. Schließlich hängt die Art und Weise, wie sich die Künstliche Intelligenz in Zukunft entwickelt, maßgeblich davon ab, wie wir uns selbst wahrnehmen – und welche Erwartungen wir an uns selbst stellen.

Mein Name ist Liwen Qin. Ich arbeite ab und zu mit IT-Firmen zusammen und werde Euch an dieser Stelle präsentieren, was ich Neues entdeckt habe.

„Ausgesprochen …“

In unserer Kolumnenreihe „Ausgesprochen …“ schreiben im wöchentlichen Wechsel Liwen Qin, Maximilian Buddenbohm, Dominic Otiang’a und Gerasimos Bekas. Liwen Qin beobachtet in „Ausgesprochen … posthuman“ den technischen Fortschritt und wie er unser Leben und unsere Gesellschaft beeinflusst: im Auto, im Büro und an der Supermarktkasse.