Das Dilemma von KI-Entscheidungen

Wer trägt die Verantwortung, wenn KI Fehler macht? Bisher waren in der Regel Menschen schuld: Jemand hat eine falsche Entscheidung getroffen, jemand hat sie genehmigt, jemand hat sie umgesetzt. Wann immer ein Problem auftrat, konnte es durch die Verantwortlichkeitskette bis zur Quelle zurückverfolgt werden.

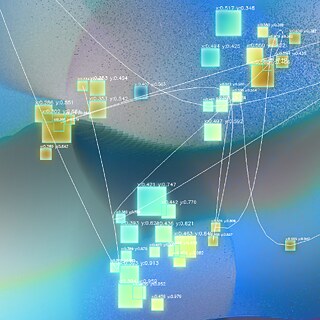

Doch je mehr KI bei Entscheidungsprozessen mitbestimmt, desto undurchsichtiger wird der Ablauf in Zukunft. Künftig wird es zunehmend schwierig sein herauszufinden, welche Daten oder Kriterien zu einem bestimmten Ergebnis geführt haben oder an welcher Stelle des Prozesses menschlicher Input eine Rolle spielte. Gleichzeitig wird es immer einfacher werden, Verantwortung abzuwälzen und die Technologie verantwortlich zu machen: „Die KI hat das so gesagt.“

Beim Workshop „Shaping AI: Ethics, Power, Responsibility“ sprach Professor Hyundeuk Cheon von der Seoul National University über diese Aspekte der KI‑Ethik, über Regulierung von Verantwortung und darüber, warum mangelnde Transparenz ein Problem ist.

Transparenz: Der Schlüssel zur KI‑Ethik

Transparenz ist ein zentraler Grundsatz ethischer KI‑Leitlinien. Ob von „Erklärbarkeit“, „Nachvollziehbarkeit“ oder „Verständlichkeit“ die Rede ist – Cheon zufolge steckt dahinter dieselbe Forderung: Es muss klar werden, warum ein System eine bestimmte Entscheidung getroffen hat.Oft kommt das Gegenargument: „Kann Technologie nicht objektiver sein? Menschen sind schließlich voreingenommen.“ Professor Cheon führte das Beispiel eines „KI-Richters“ an. Der Ersatz menschlicher Richter durch KI mag zunächst fair erscheinen, doch bevor das geschieht, muss geklärt werden, was „Fairness“ überhaupt bedeutet. Menschen müssen festlegen, welche Ziele optimiert werden sollen, welche Fehler gefährlich sind und welche Daten einbezogen oder ausgeschlossen werden. KI spiegelt diese gesellschaftlichen Wertentscheidungen wider.

Die Annahme, dass Technologie automatisch objektiver sei, ist irreführend und gefährlich. Je mehr das Thema Fairness diskutiert wird, desto häufiger werden Entscheidungen auf transparente Prozesse und Kennzahlen gestützt – aber auch diese beruhen auf vorherigen Werturteilen.

Das Verantwortungs‑Vakuum autonomer Technologien

Mit zunehmender Autonomie der KI übertragen wir ihr mehr Entscheidungs‑ und Handlungsspielräume. Beispiele sind selbstfahrende Autos, autonome Waffensysteme oder agentenbasierte KI. Ihre Nutzung wird mit überzeugenden Argumenten begründet: Autonome Fahrzeuge reduzieren Unfälle durch menschliches Versagen und verbessern die Mobilität benachteiligter Gruppen. Autonome Waffensysteme verringern Opferzahlen und psychischen Stress für Soldaten. Agentenbasierte KI erledigt Aufgaben schneller und effizienter.„Aber das ist nicht die ganze Wahrheit“, sagte Cheon. Höhere Effizienz kann Verantwortlichkeit untergraben. Menschen sind autonome Akteure und verantwortlich für ihr Handeln – doch was passiert, wenn Entscheidungen und Handlungen an Maschinen delegiert werden? Maschinen haben keinen freien Willen, keine Absichten und kein Bewusstsein für Konsequenzen.

Das führt zu einer zentralen Frage: Wer trägt die Verantwortung? Im Krieg etwa: Wenn eine Drohne Zivilisten tötet, ist der Entwickler verantwortlich, der Befehlshaber – oder die Drohne? Entwickler und Befehlshaber könnten sagen: „Das haben wir nicht befohlen.“ Die Drohne selbst kann nicht zur Rechenschaft gezogen werden. So entsteht eine „Verantwortungslücke“.

Cheon plädiert daher für ein erweitertes Verständnis von Verantwortung, das Kriterien wie die Befehlskette, die Voraussetzungen und den Nutzen des jeweiligen Systems berücksichtigt. Wenn wir an der Denkweise „Ich habe es selbst getan, also bin ich verantwortlich“ festhalten, wird dieses Verantwortungs‑Vakuum nur noch größer – denn kaum jemand tut heute noch etwas völlig alleine.

Wenn Black Boxes den öffentlichen Raum erobern

Cheon brachte das Problem der KI‑Black‑Box auf den Punkt: „Für den verantwortungsvollen Einsatz von KI muss das System erklärbar sein, und diese Erklärung muss den Nutzer*innen zugänglich gemacht werden.“ Wenn nur Ergebnisse präsentiert werden, ohne ihre Begründung offenzulegen, fehlt den Menschen die Grundlage, diese Ergebnisse anzunehmen oder abzulehnen.Er betonte außerdem, dass „Intransparenz“ ein vielschichtiges Problem sei. Dazu gehört die absichtliche Geheimhaltung durch Unternehmen, die Geschäftsgeheimnisse wahren wollen. Aber auch nach Offenlegung erschweren komplexe technische Systeme Laien das Verständnis der zugrunde liegenden Entscheidungslogik. Die größte Herausforderung ist jedoch, dass selbst Entwickler und Expert*innen die Ergebnisse oft nicht präzise vorhersagen können.

Cheon verglich diese Situation mit Kafkas Roman Der Prozess, in dem Josef K. verhaftet – und schließlich hingerichtet – wird, ohne jemals zu erfahren, warum. Diese Schlussszene zeige, „wie leicht ein unerklärtes Urteil Menschen entmachten kann“. Wenn politische Entscheidungen nicht erklärt werden, bleiben die Betroffenen von der Entscheidungsfindung ausgeschlossen.

Ein weiteres Beispiel war die Entlassung der Lehrerin Sarah Wysocki aus einer öffentlichen Grundschule in Washington, D.C. Sie wurde trotz ihrer anerkannten Kompetenz entlassen, weil sie eine niedrige Bewertung durch ein Lehrkräfte‑Evaluationssystem erhielt. Alles, was der Schulvorstand dazu sagen konnte, war: „Der Algorithmus hat ihre Bewertung berechnet.“ Politische Entscheidungen, die auf diese Weise getroffen werden, werden ohne jede Begründung einfach verkündet.

Cheon ergänzte, dass Transparenz keine Frage der „Höflichkeit“ sei. Politische Entscheidungen müssen durch öffentlich akzeptable Gründe gerechtfertigt werden. Transparenz ist eine notwendige Voraussetzung für Vertrauen.

Transparenz als Bürgerrecht

Was sollten wir als Gesellschaft also fordern? Cheon zufolge müssen KI‑Systeme im öffentlichen Raum so gestaltet sein, dass die Bevölkerung nachvollziehen kann, wie und warum Entscheidungen getroffen werden. Nur so können wir zustimmen, widersprechen oder eine Überprüfung fordern. Transparenz ist also erneut keine Höflichkeitsgeste, sondern eine Mindestanforderung an demokratische Entscheidungsprozesse.Cheon warnte davor, die Zukunftsbilder allein multinationalen Technologiekonzernen zu überlassen. Technologie ist kein Naturereignis, das uns überrollt – sie ist das Ergebnis von Zielen, von Konzepten und deren Umsetzung. Die Entwicklung einer Zivilgesellschaft hängt davon ab, dass Menschen sich einbringen, ihre Stimme erheben, einander zuhören und auftretende Probleme diskutieren. Politische Entscheidungen müssen öffentlich erklärt werden – und die Zivilgesellschaft muss ihr Recht einfordern, solche Erklärungen zu erhalten.

Autorin: Soyoung Choi

Koreanisches Lektorat: Young-Rong Choo

Lektorat & Konzept: Leslie Klatte

Englische Übersetzung: Eric Rosencrantz

Deutsche Übersetzung: Star Korea AG