Die Gefahr vom KI-Überfluss

KI wird heute zunehmend weniger als reine Technologie verstanden, sondern als Dienstleistung und Produkt. KI‑Services sind gezielt für eine langfristige Nutzung entwickelt – je häufiger Menschen sie verwenden, desto wertvoller werden sie für die Anbieter. KI ist also kein neutrales Werkzeug: Sie ist ein Konsumprodukt, das Übernutzung – und sogar Missbrauch und Abhängigkeit – fördert. Das Problem: Wir haben KI bereits tief in unseren Alltag integriert, ohne die möglichen Folgen wirklich zu überblicken.

Irreführende Begriffe und überhöhte Erwartungen

Beim Workshop „Shaping AI: Ethics, Power, Responsibility“ stellte Youjin Jeon vom Woman Open Tech Lab in Korea grundlegende Annahmen über KI in Frage: den weit verbreiteten Glauben an technologische Neutralität, die Autoritätswirkung des Begriffs „künstliche Intelligenz“ sowie die überzogenen Erwartungen, die der Begriff „Intelligenz“ weckt.KI lernt aus den Daten, mit denen sie trainiert wird – und wenn diese Daten verzerrt sind, sind es auch die Ergebnisse. Trotzdem vertrauen wir Technologie oft als objektivem Urteil. Genau hier, so Jeon, beginne das Problem.

„Warum nennen wir es eigentlich ‚Intelligenz‘?“ fragte Jeon immer wieder. Begriffe wie „Intelligenz“, „Denken“ oder „Verstehen“ wirken passend, führen jedoch dazu, dass wir Technologie vermenschlichen – also annehmen, sie sei einem Menschen ähnlich. Selbst das Wort „general“ in „Artificial General Intelligence“ (AGI) kann zwischen „normal“ und „abnormal“ unterscheiden und damit normative Vorstellungen mittransportieren. Diese Sprache erzeugt übersteigerte Erwartungen und Ängste – unabhängig davon, was die Technologie tatsächlich kann.

Warum Bias kein Fehler ist, sondern ein Spiegel

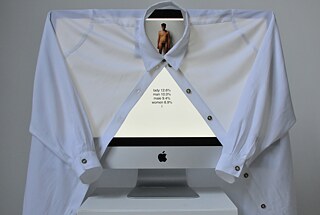

Ein Beispiel für KI‑Bias ist Max Doveys „Computer-Vision“-Experiment [1] von 2015: Der Computer ordnete einen Mann im Anzug als „erfolgreichen Geschäftsmann“ ein, einen nackten Mann jedoch als „Frau“. Solche Ergebnisse sind keine harmlosen Irrtümer – sie zeigen, wie KI aus gelernten Bildmustern gesellschaftliche Erwartungen reproduziert. Die automatische Verknüpfung von Nacktheit mit Weiblichkeit wird damit im System selbst gespeichert.

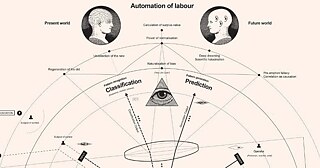

Nooscope Manifesto

Jeon sensibilisierte beim Workshop besonders Künstler*innen für dieses Thema. Anhand des Nooscope Manifesto [2] von Matteo Pasquinelli und Vladan Joler, das auf der 13. Gwangju Biennale vorgestellt wurde, zeigte sie: Dieses Manifest versucht, KI nicht als intelligentes, fühlendes Wesen darzustellen, sondern als kognitives Werkzeug zur Analyse gesellschaftlicher Muster. Diese Muster liegen in riesigen Datenmengen verborgen, die für Menschen kaum überschaubar sind. Statt die Technologie zu mystifizieren, so Jeon, sollten wir fragen, was sie eigentlich misst – und was sie systematisch ausblendet.

Wie KI Beziehungen verändert

Aktuelle Studien [3]zeigen, dass viele Menschen generative KI nicht für klassische Aufgaben wie Übersetzungen oder Recherchen nutzen, sondern für „Ratschläge“ oder „emotionale Unterstützung“. KI‑Chatbots sind stets freundlich, widersprechen nie und unterbrechen nicht – und vermeiden so genau jene Konflikte und Reibungen, die menschliche Beziehungen prägen.Jeon betonte, dass dies weit über bloßen Komfort hinausgeht: Es verändert Beziehungsstrukturen. Reibungslose Interaktionen sind angenehm, doch sie nehmen uns die Möglichkeit, aus Meinungsverschiedenheiten zu lernen. Je optimierter KI im „freundlichen Gespräch“ wird, desto eher bevorzugen wir Bequemlichkeit gegenüber Ehrlichkeit. Das Risiko: Wir verlieren den Wert von Authentizität aus dem Blick.

Die Macht bewussten Konsums

Jeon machte auch auf unsere Rolle als Konsument*innen von KI aufmerksam. Wir investieren bereitwillig viel Zeit und Geld in Smartphones, Abos und KI‑Tools. Bei anderen teuren oder zeitintensiven Produkten würden wir unseren Konsum eher infrage stellen – bei Technologie hingegen kaum.Doch wir haben Handlungsspielräume: Wir können unseren Konsum reduzieren, alternative Dienste wählen oder Kritik äußern. Jeon bezeichnet dieses Verhalten als das einer „intervenierenden Nutzerin“ bzw. eines „intervenierenden Nutzers“. In einer Zeit, in der KI-Nutzung zur Norm geworden ist, müssen wir bewusst entscheiden, welche Aufgaben wir Maschinen überlassen und welche wir selbst behalten sollten.

Fragen für das KI‑Zeitalter

Wie wollen wir in einer Gegenwart leben, die bereits stark von KI geprägt ist? Was geben wir auf, wenn wir KI zur Effizienzsteigerung nutzen? Was bleibt von menschlichem Urteil, eigenständigem Denken, Authentizität und persönlichen Beziehungen?Da KI weltweit Teil der alltäglichen Infrastruktur geworden ist, betreffen diese Fragen Korea ebenso wie jede andere Gesellschaft. Auch wenn gesellschaftliche Debatten der technologischen Entwicklung hinterherhinken, gilt umso mehr: Gerade deshalb müssen wir diese Fragen jetzt stellen – bevor es zu spät ist.

Autorin: Soyoung Choi

Koreanisches Lektorat: Young-Rong Choo

Lektorat & Konzept: Leslie Klatte

Englische Übersetzung: Eric Rosencrantz

Deutsche Übersetzung: Star Korea AG